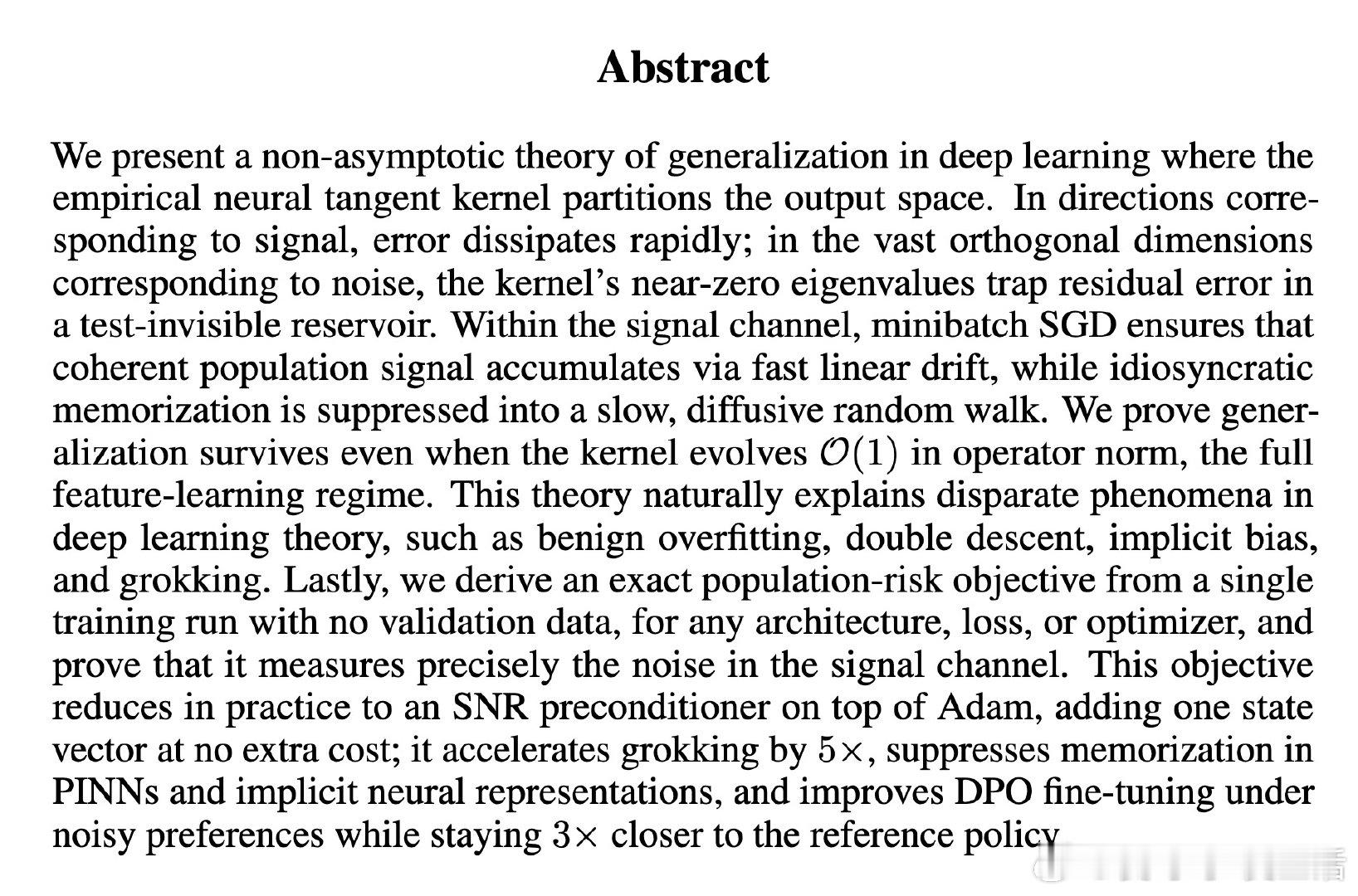

[LG]《A Theory of Generalization in Deep Learning》E Litman, G Guo [Stanford University] (2026)

在深度学习泛化中,过参模型为何能记住噪声却仍能测试有效,是一个悬而未决的难题。过去的方法受困于冻结核或容量界,本质原因是它们看不到训练轨迹中的输出方向分流。

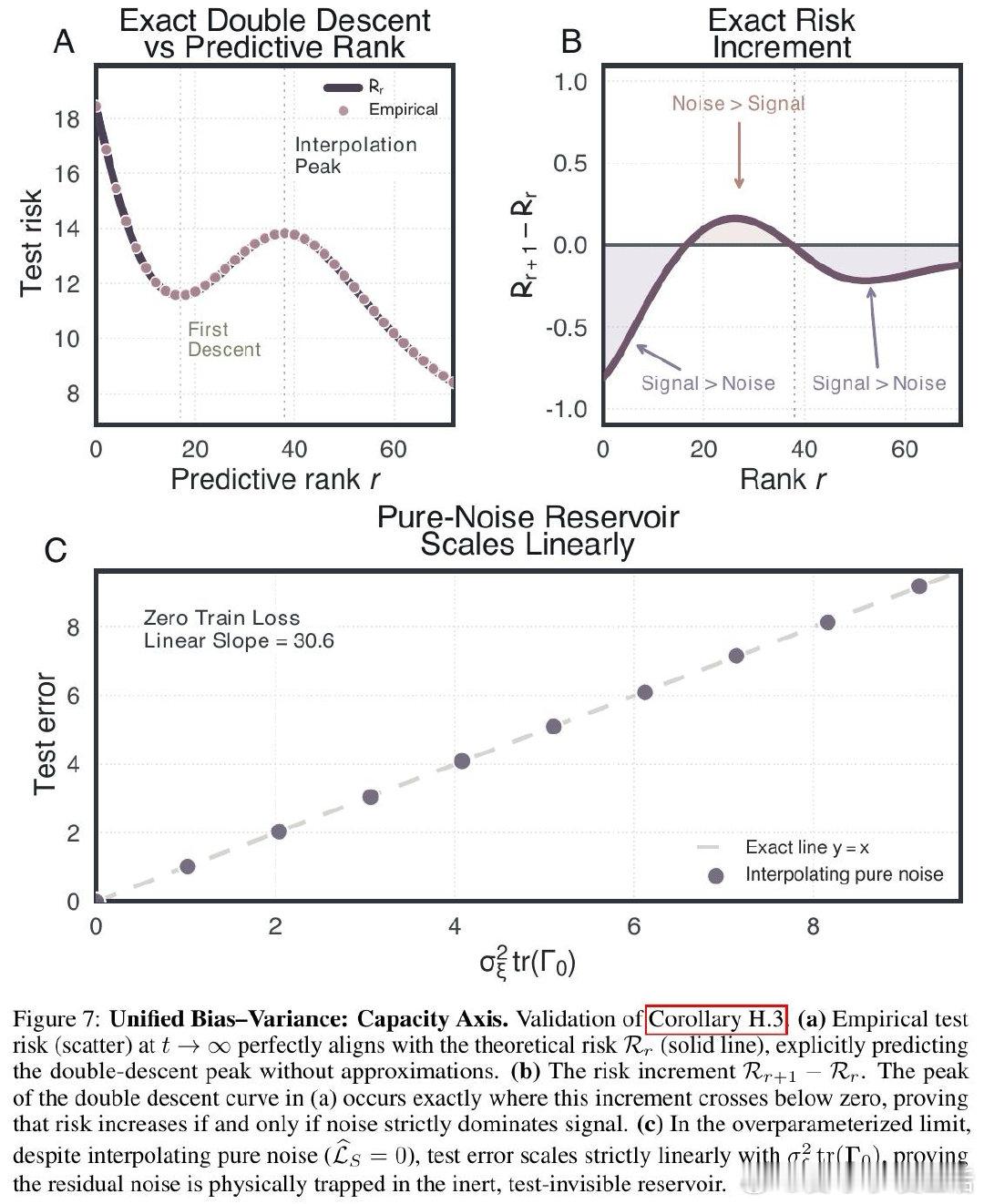

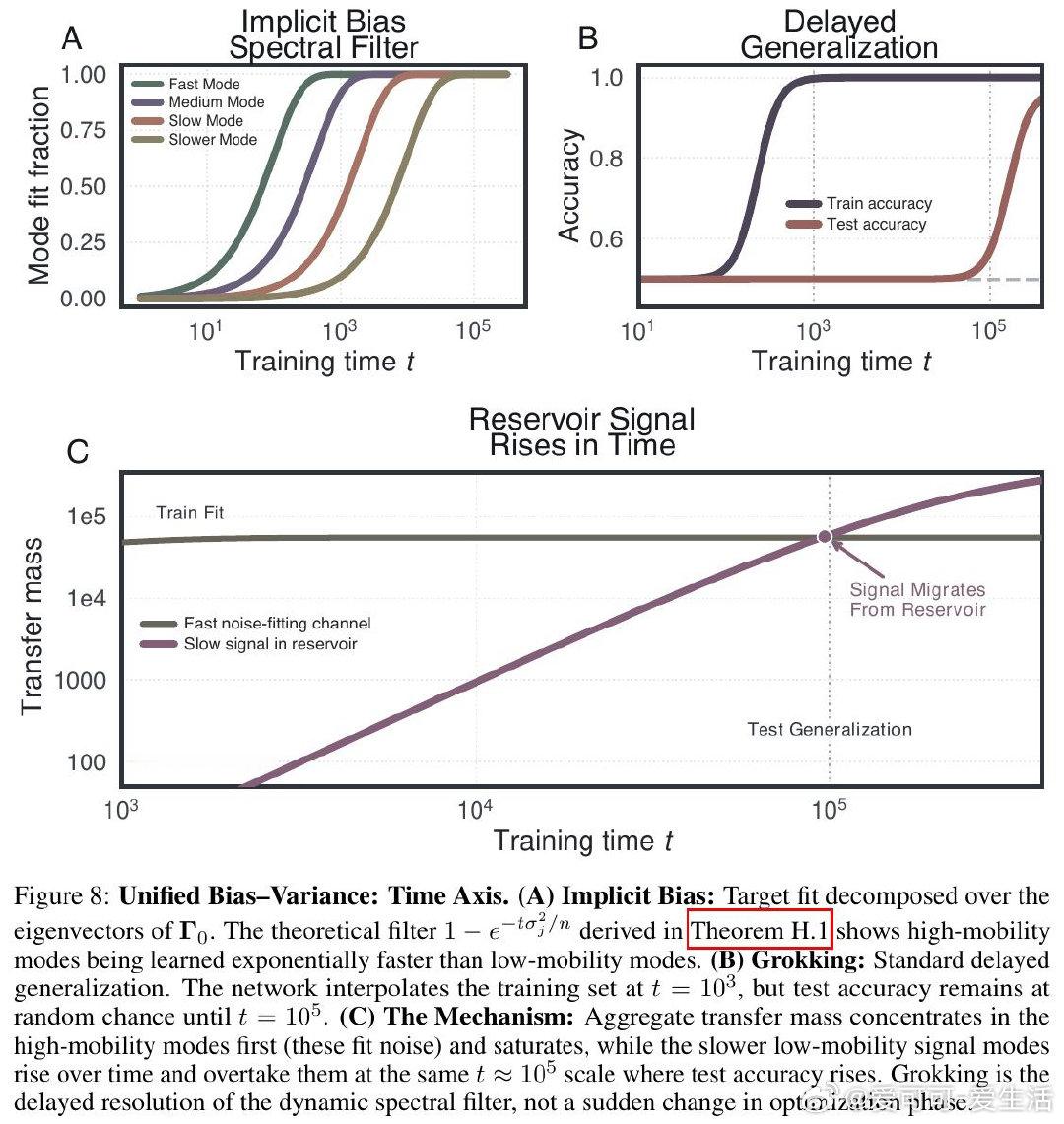

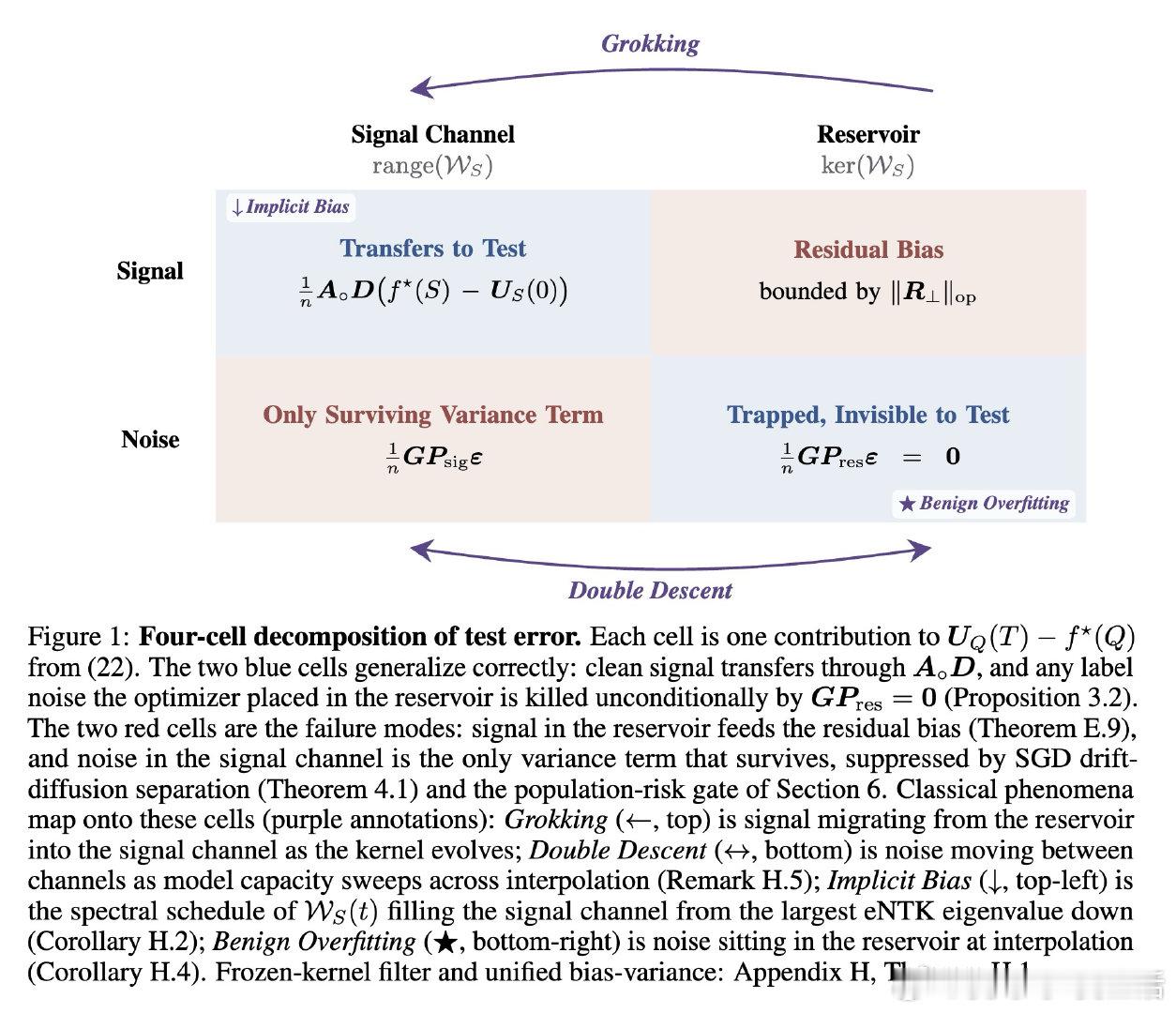

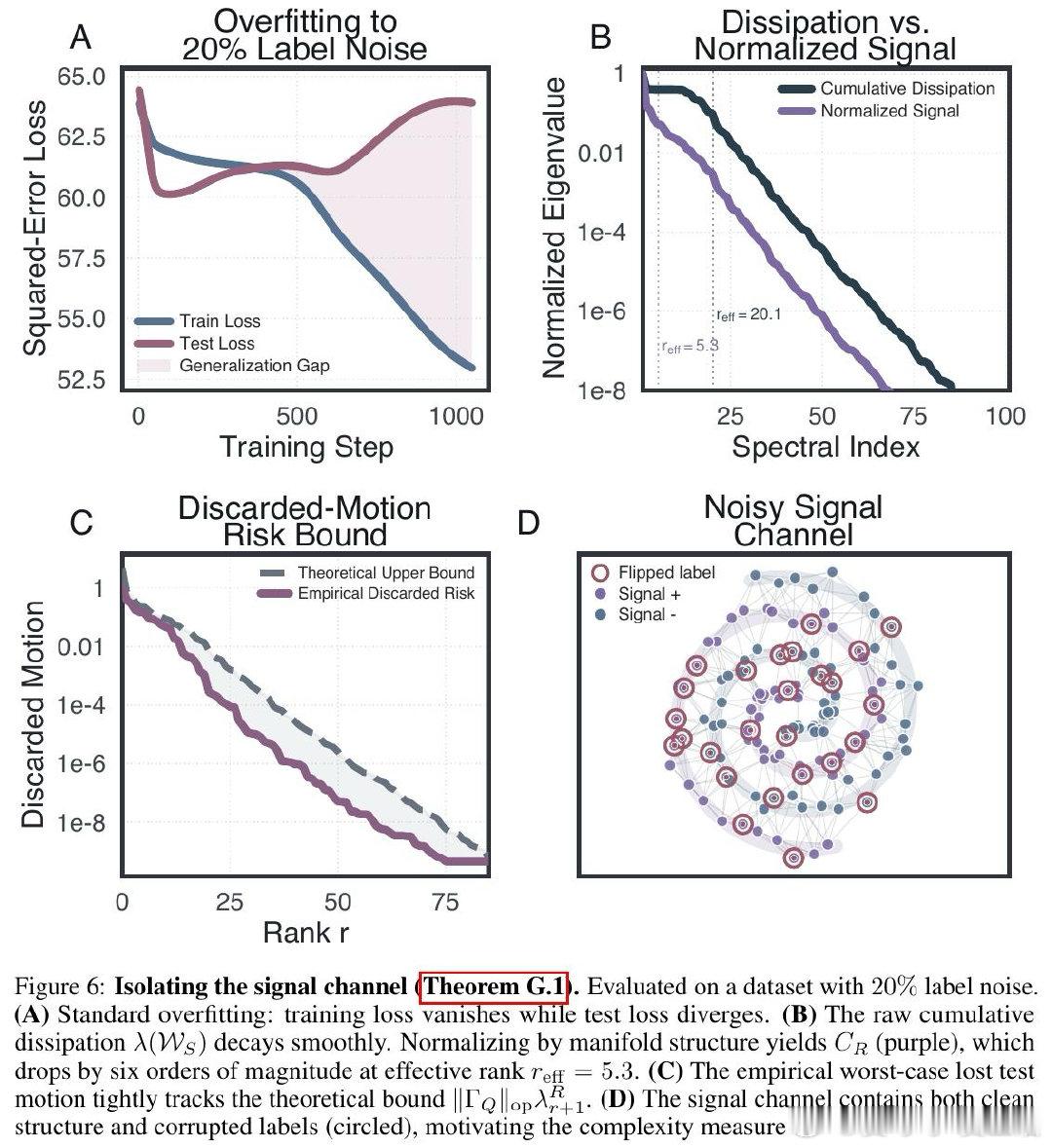

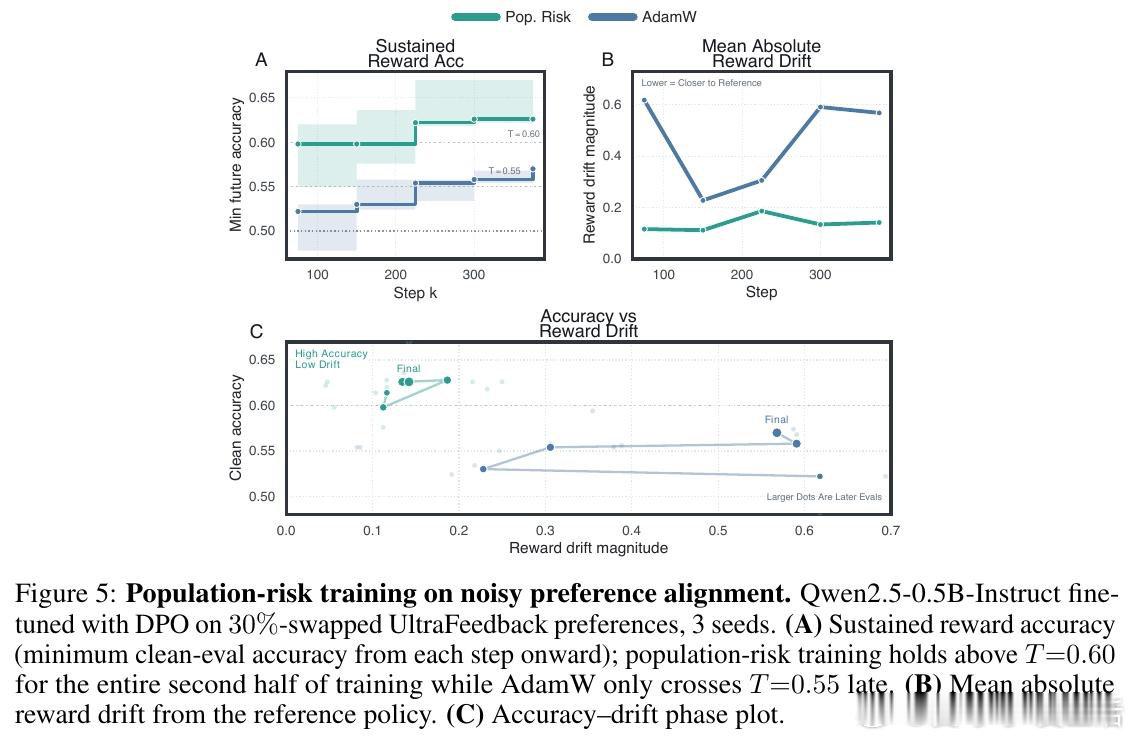

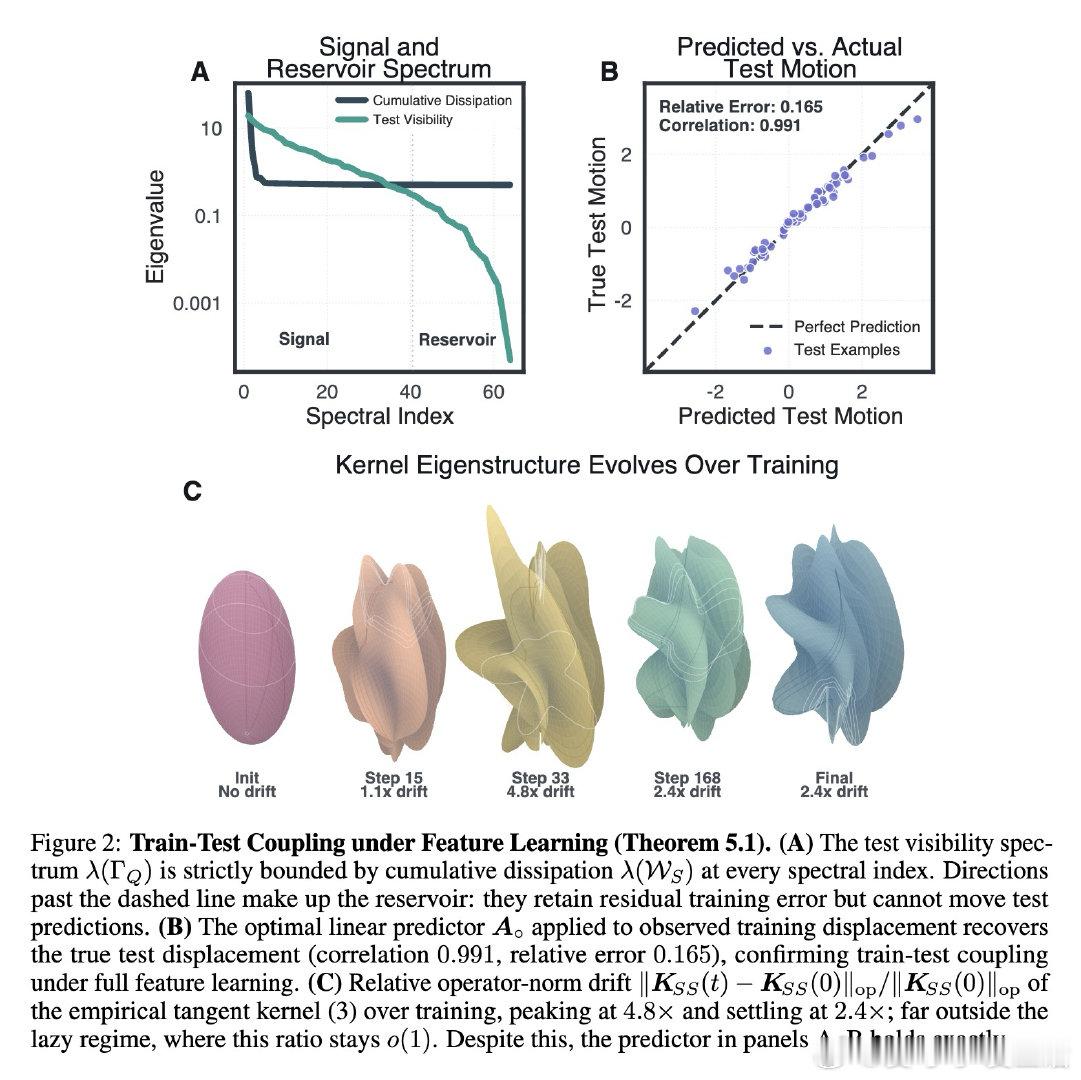

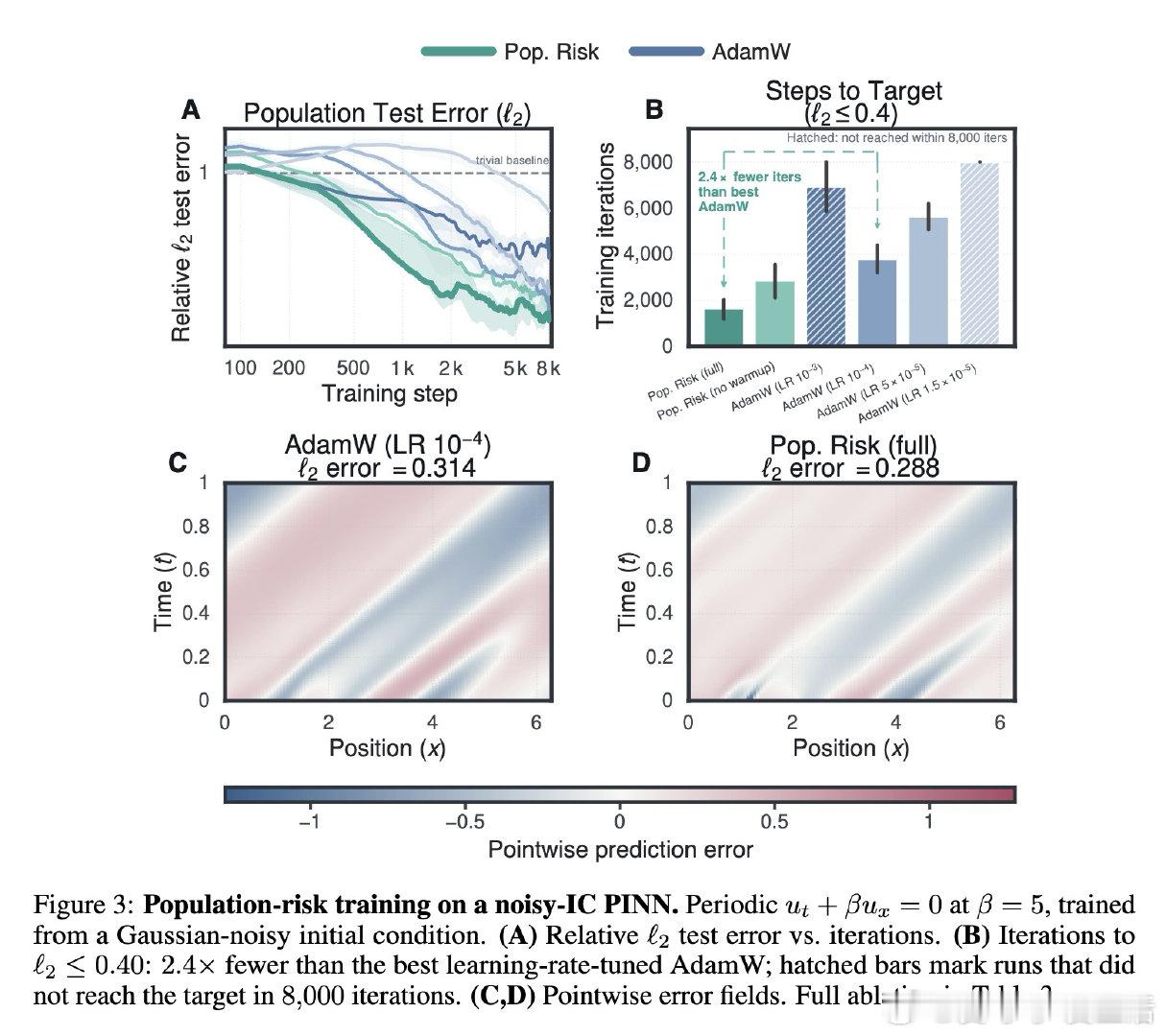

本文的核心洞见是:把经验NTK重新看作输出空间的分区器。由此,信号通道快速耗散可泛化误差,而储藏池困住测试不可见噪声,使记忆与泛化可同时成立。

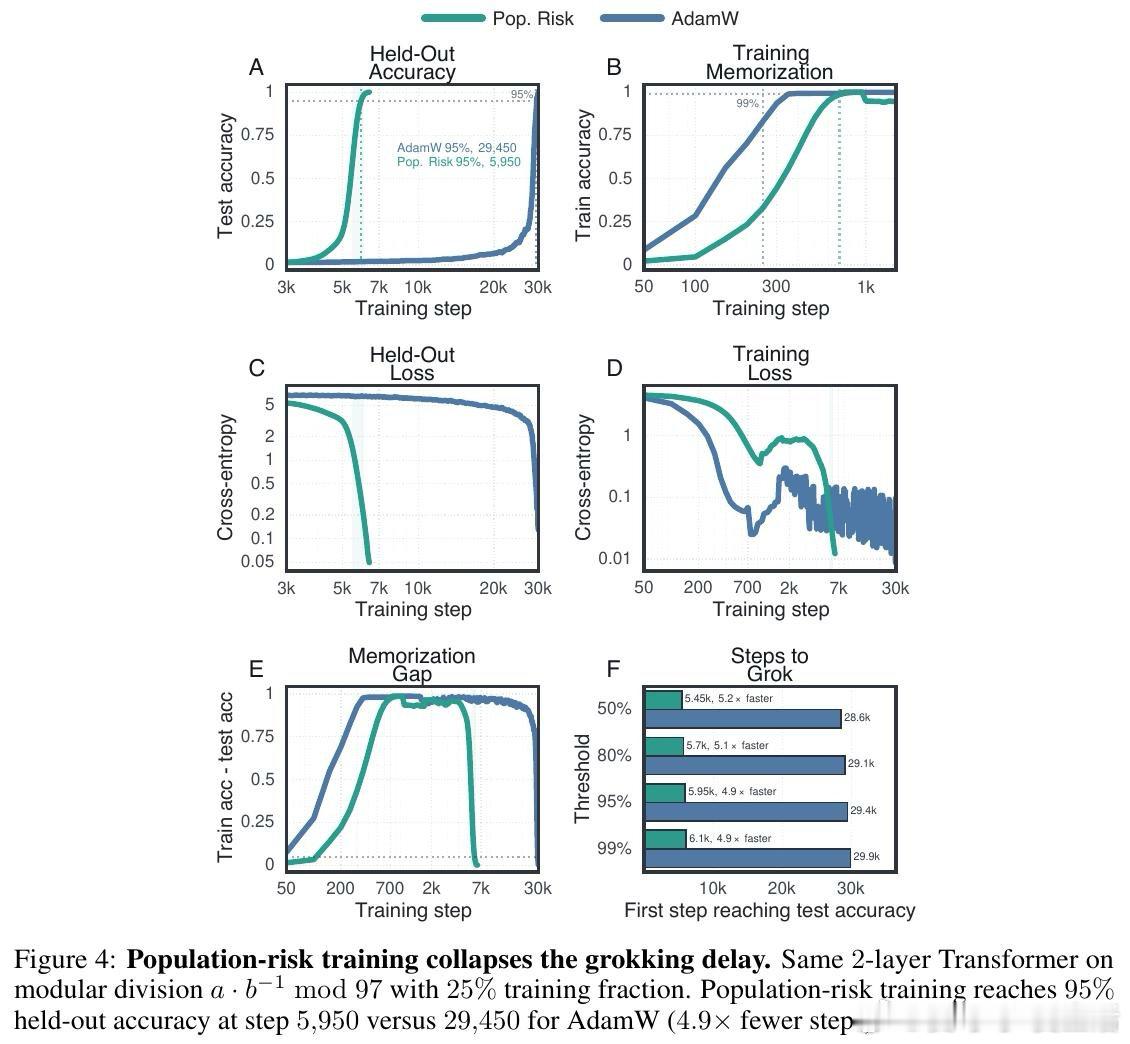

这项工作真正留下的遗产是用一套轨迹算子串起良性过拟合、双降、隐式偏置与grokking。它打开的新门是无验证集的人口风险训练,但尚未跨过强假设下的广泛实证检验。

arxiv.org/abs/2605.01172 机器学习 人工智能 论文 AI创造营