[CL]《Hallucinations Undermine Trust; Metacognition is a Way Forward》G Yona, M Geva, Y Matias [Google Research & Tel Aviv University] (2026)

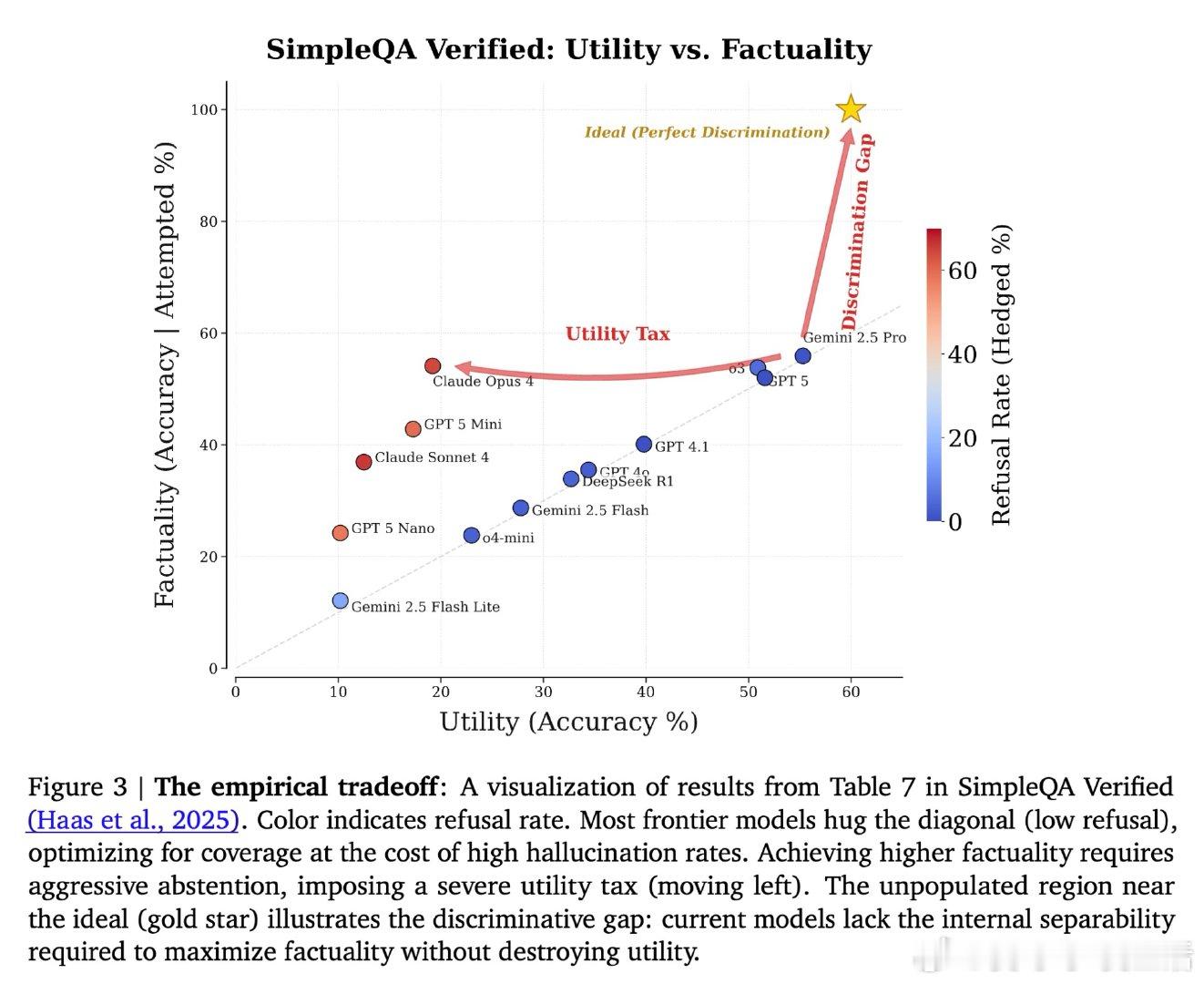

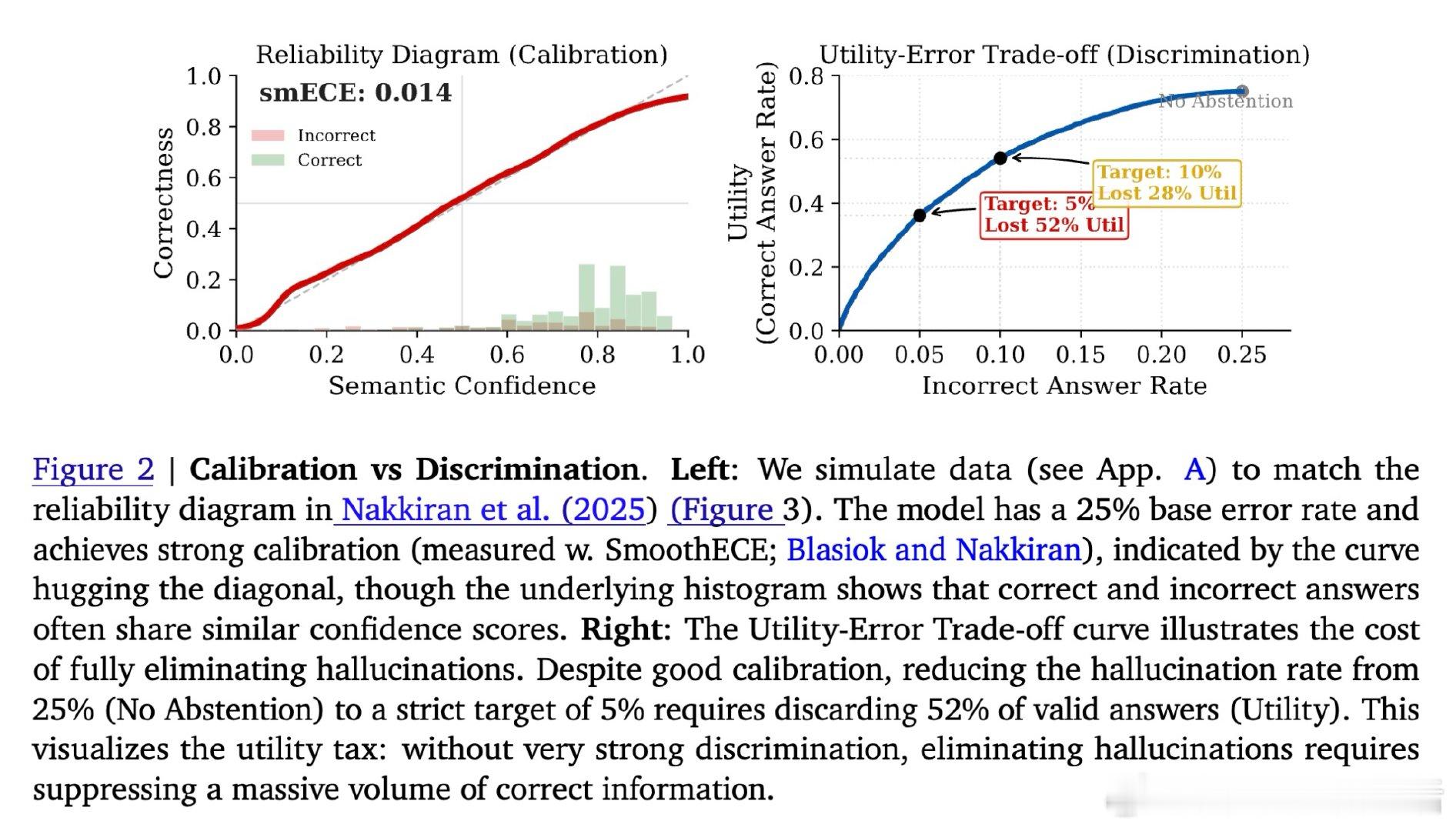

在事实问答中,幻觉仍是一个悬而未决的难题。过去的方法受困于扩充模型知识,本质原因是模型难以分清自己知道与不知道。

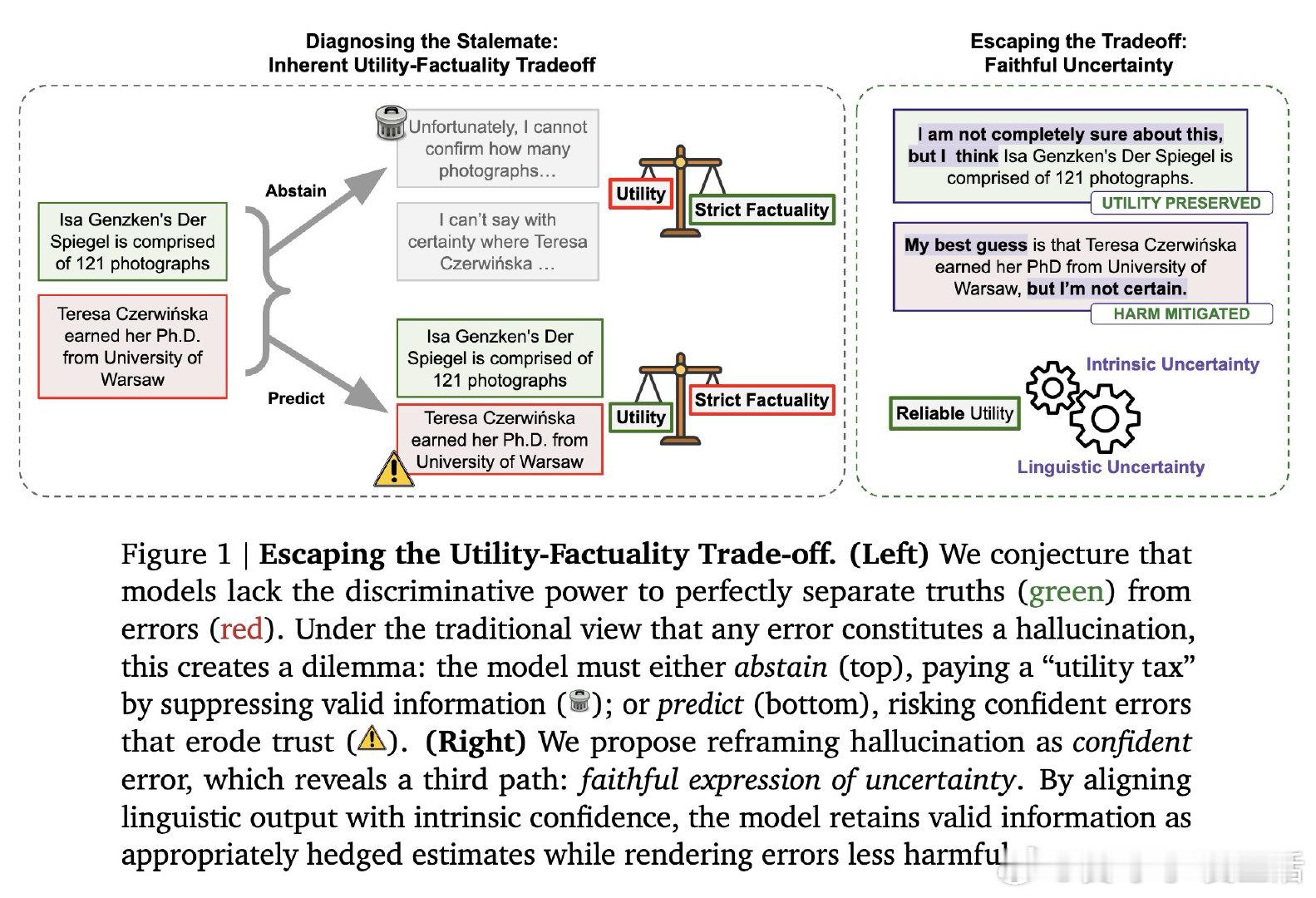

本文的核心洞见是:把幻觉重新看作“自信的错误”。由此,让语言中的不确定性对齐内部不确定性,使模型不必在回答与拒答间二选一。

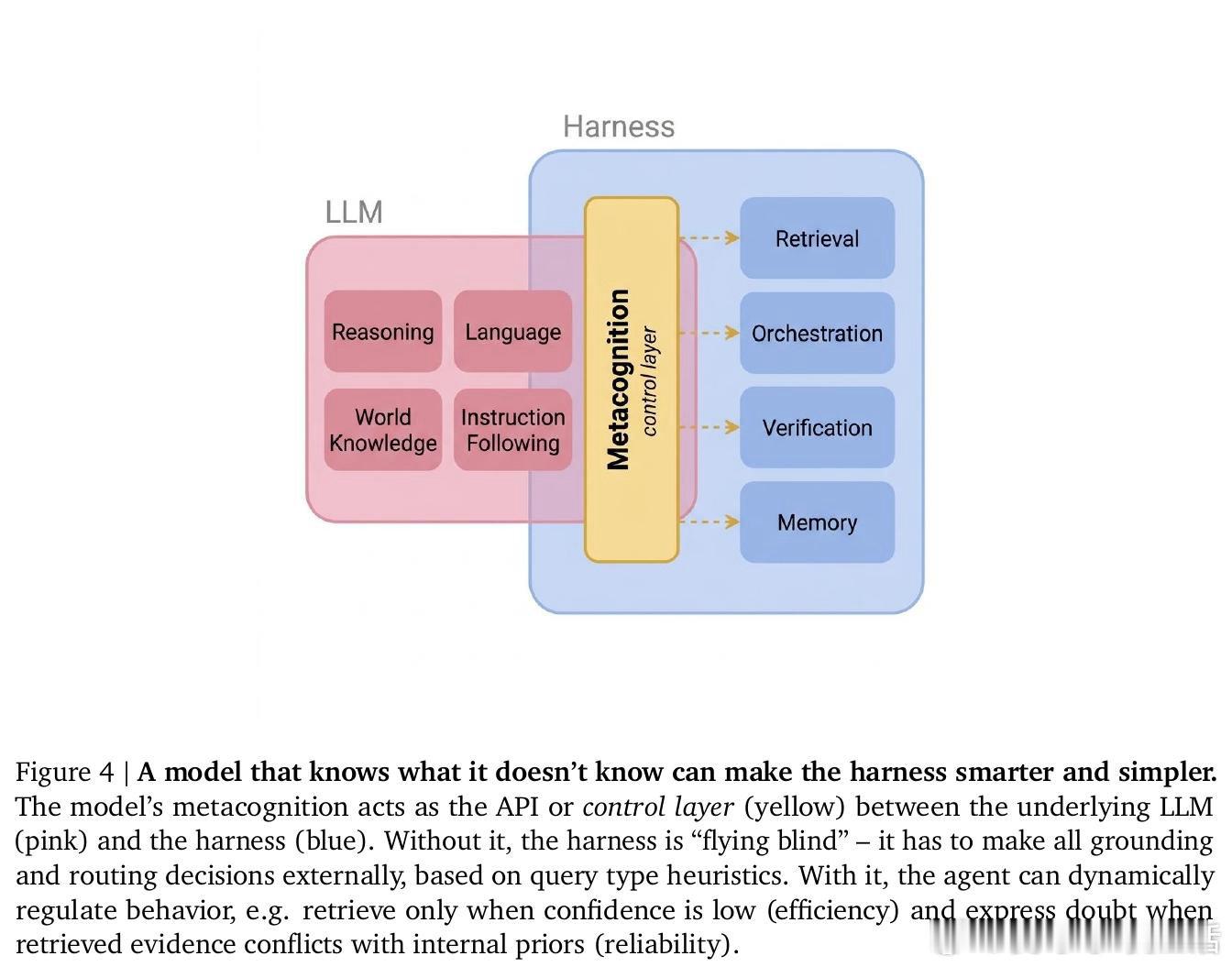

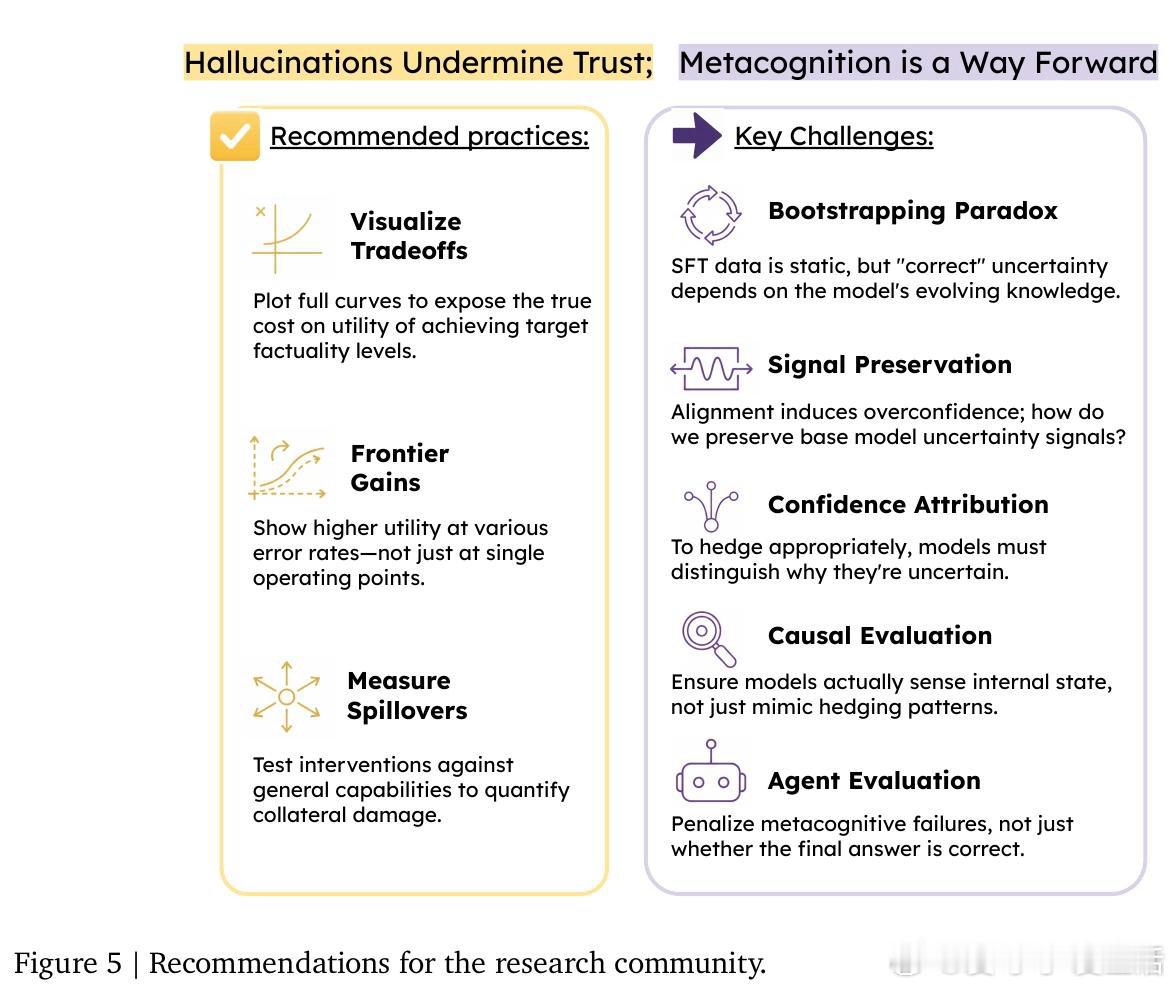

这项工作真正留下的遗产是把可信度从“必须答对”改成“诚实暴露把握”。它打开的新门是用元认知控制检索与工具调用,但尚未跨过如何可靠训练这种自知。

arxiv.org/abs/2605.01428 机器学习 人工智能 论文 AI创造营