[CL]《Learning to Interrupt in Language-based Multi-agent Communication》D Wang, D Yin, R Desai, L Li… [CMU & Meta FAIR] (2026)

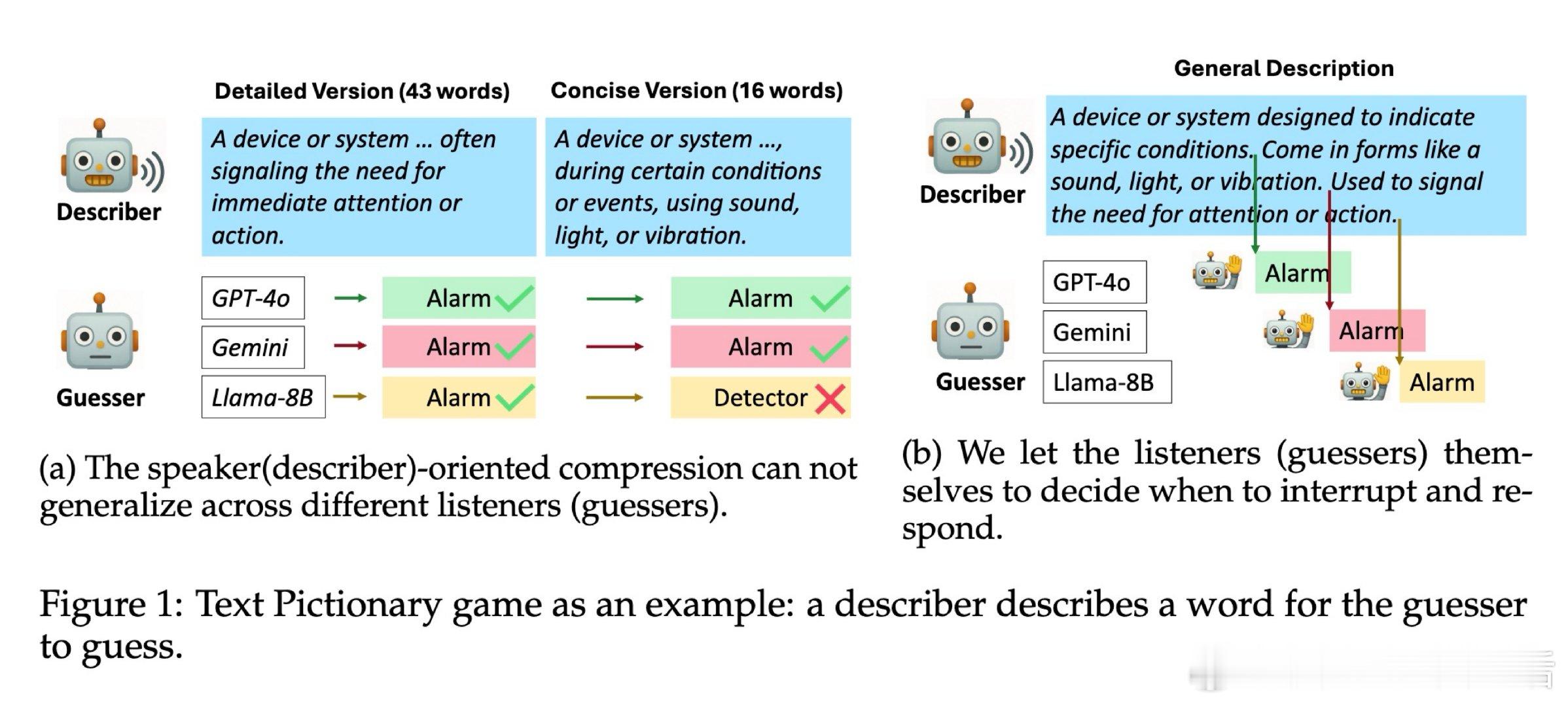

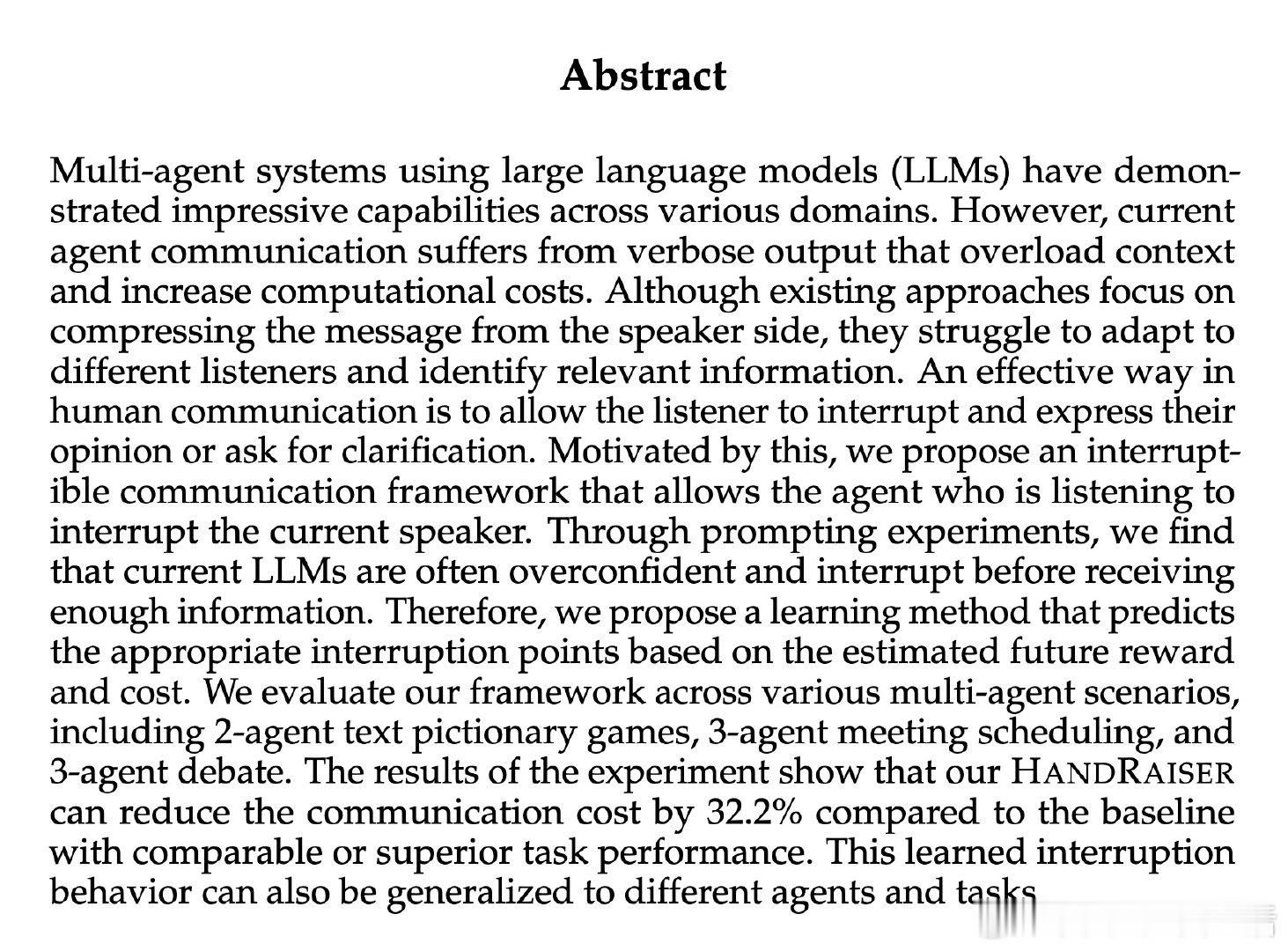

在多智能体 LLM 系统中,冗长的消息使上下文急剧膨胀,拖慢推理速度、降低任务性能。过去的解决思路都盯着「说话者」——压缩输出长度;但说话者无法预知对方需要什么,对不同听者强行裁剪,信息要么过载要么不足,问题始终悬而未决。

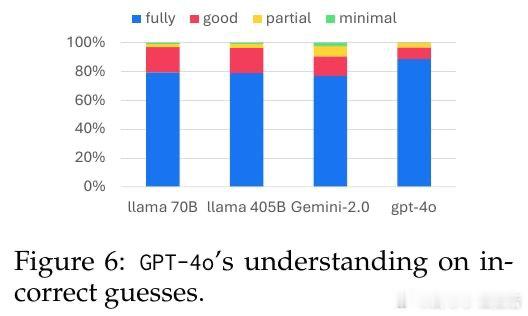

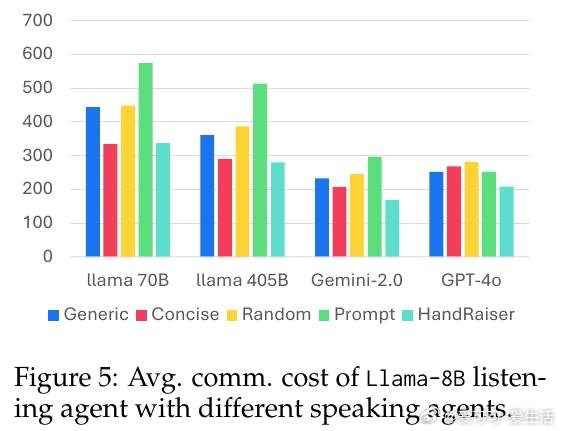

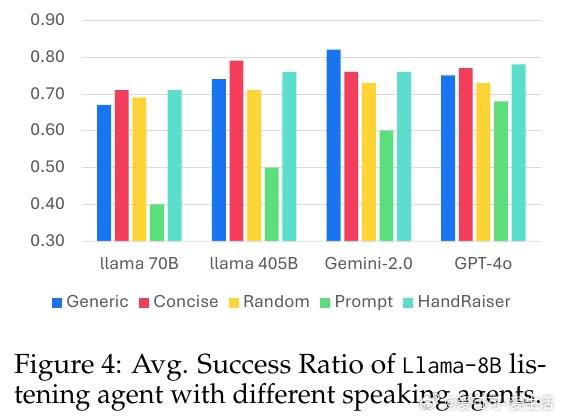

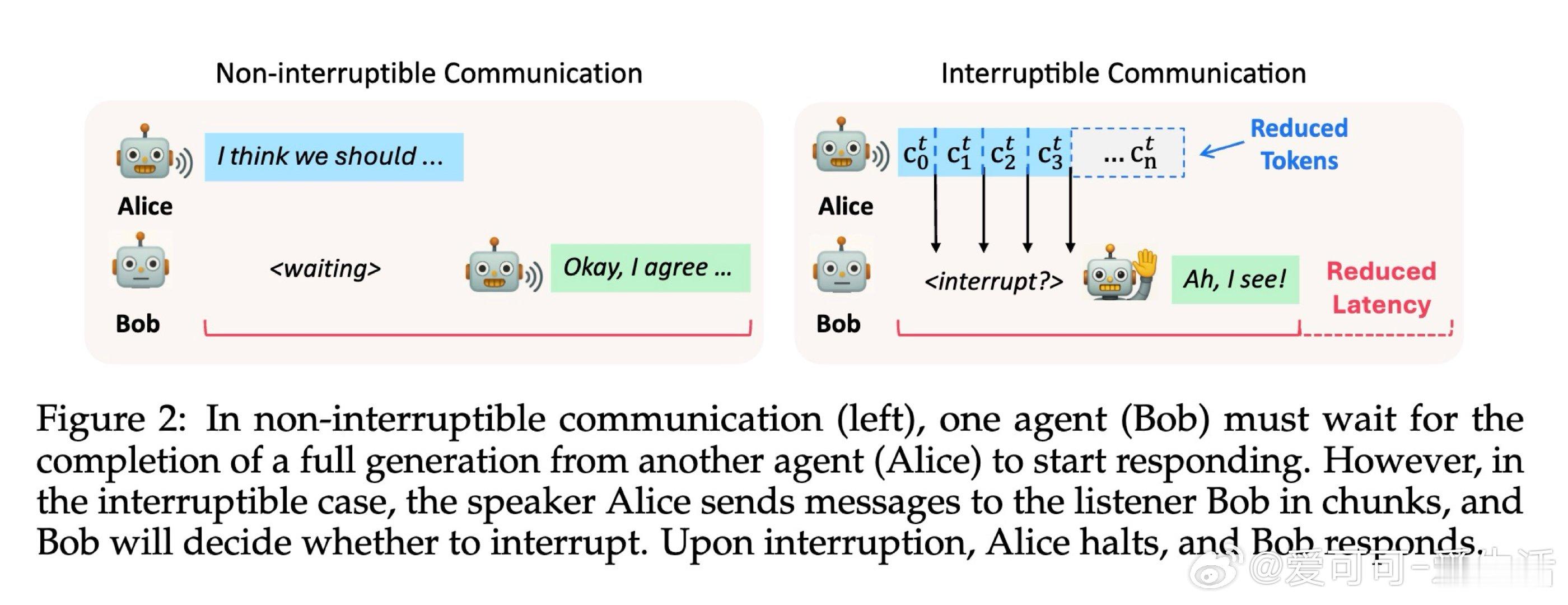

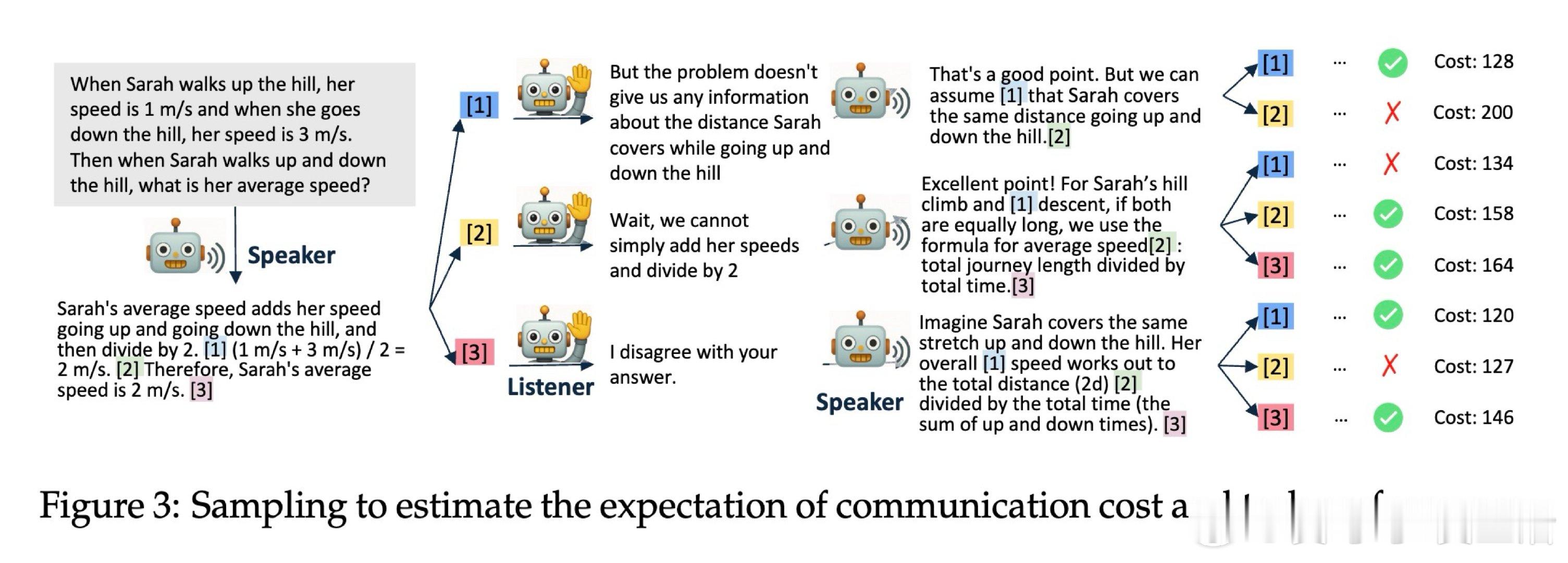

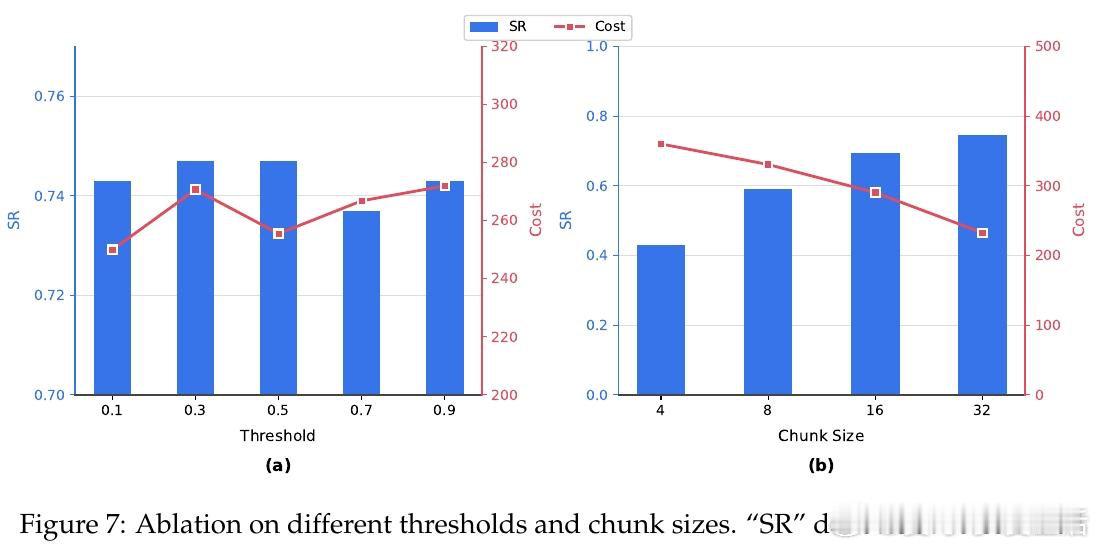

本文的核心洞见是:把「何时停止输入」的决定权,从说话者转移给听者。由此,「听者主动举手打断」这一操作使问题得以解开——听者在流式接收消息的过程中,逐块评估当前信息是否足够响应;通过树状采样估算打断后的未来收益与损耗,筛选出「节省 token 且不损失任务表现」的打断时机,并以此标注数据微调模型。

这项工作真正留下的遗产是:证明了「听者侧主动打断」是独立于说话者压缩的正交优化维度,可叠加使用,且习得的打断行为能跨任务、跨说话者迁移。它为后来者打开的新门是:在真正开放的多向多智能体对话中实现动态、对称的打断协议。但尚未跨过的门槛是:多智能体同时竞争打断时,轮次反而增多,复杂场景下的打断效率仍有待专项训练。

arxiv.org/abs/2604.06452 机器学习 人工智能 论文 AI创造营