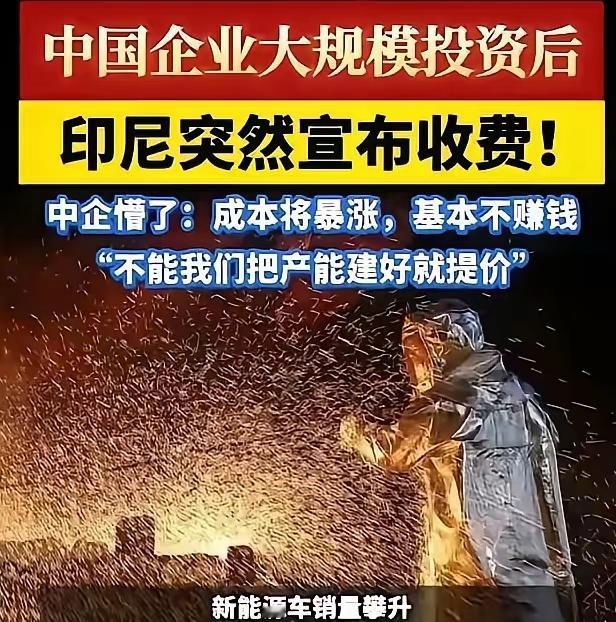

韩国传来一个大消息, 2026年5月7日,韩国政府宣布了一个大消息。他们要组建一个新的机构,专门对付“数字性犯罪”。什么是数字性犯罪呢?就是在公共场合偷偷拍别人,还有用人工智能技术把别人的脸换到不雅视频里。这个新机构名字很长,叫“数字性犯罪受害者综合支援组”,里面有好几个部门的专家。 韩国民间早就对数字性犯罪怨声载道,普通人出门逛街都要时刻提防被偷拍。 还有不少普通女性,莫名被人用AI换脸做成低俗影像,生活彻底被打乱。 韩国性别平等家族部公开数据显示,近年这类案件一年比一年多,暗地里没敢报案的受害者更是多得吓人。 很多年轻人随便在网上就能下载简易AI换脸工具,不用懂专业技术,几分钟就能合成虚假不雅视频。 就算警方一次次下架非法视频,封禁相关网站,新的链接和账号转眼又冒出来,根本堵不住。 不同部门各管一摊,办事流程绕来绕去,等到手续批下来,不良内容早就传遍各大网络角落。 韩国这次终于动真格了。数字性犯罪早就不是新鲜事,但AI换脸技术让问题升级到恐怖级别。以前偷拍还得找角度、躲视线,现在只要一张社交媒体上的正面照,AI就能自动生成以假乱真的不雅视频。韩国网络性犯罪举报中心去年接到近12万起投诉,比五年前翻了四倍。这还只是敢举报的,更多受害者选择沉默,怕二次伤害,怕社会歧视。 新成立的“综合支援组”听着挺全面,警察厅、法务部、女性家族部、科技部的专家都凑到一起。想法是好的,一个窗口受理,快速删除内容,提供法律和心理援助。但关键看执行。韩国官僚体系出了名的效率低,部门之间踢皮球是常态。这次能不能打破壁垒,还得打个问号。更麻烦的是,很多非法网站服务器架在国外,韩国法律管不着。你这边刚删完,那边换个域名又复活了。 技术跑得比法律快太多了。现在用的AI换脸工具,很多是开源代码改的,中学生都能上手。Deepfake检测技术也在发展,但总是慢半拍。等你研发出新算法,犯罪者早就用上更新版的生成工具了。这场猫鼠游戏,老鼠永远领先一步。法律更是跟不上,韩国现行《性暴力犯罪处罚特别法》对偷拍判得重,但对AI换脸量刑模糊,最高也就判五年。比起受害者一辈子毁掉,这惩罚太轻了。 看看其他国家怎么做的。欧盟去年通过《人工智能法案》,把深度伪造列为高风险技术,要求强制标注。美国十几个州有专门的反Deepfake法律,受害者可以起诉平台和制作者。中国也出台规定,严禁利用AI生成虚假信息。但这些都侧重事后监管,防不住犯罪发生。韩国这次想搞“综合支援”,算是往前迈了一步,但光靠政府不够,得把平台企业拉进来。 平台责任是关键。那些色情网站、社交媒体是传播主渠道。韩国法律要求平台接到举报后24小时内删除内容,可很多小网站根本不理你。大平台像Meta、谷歌配合度高点,但他们用的是全球统一政策,不会为韩国单独改算法。更别说Telegram这种加密通讯软件,服务器在海外,内容端到端加密,政府想查都难。新支援组要啃下这些硬骨头,不容易。 受害者支援不能光删视频。心理创伤才是长期的。很多受害者患上抑郁症、焦虑症,不敢出门,不敢上网。韩国现有的心理咨询服务分散在各个机构,申请手续复杂,等待时间长。新机构承诺提供“一站式”服务,如果能兑现,算是重大进步。但人手和经费够不够?韩国政府给这个组批了多少预算,还没公布。别雷声大雨点小,最后变成又一个摆设。 从根子上看,数字性犯罪泛滥是社会文化问题。韩国男尊女卑思想依然严重,物化女性的风气没根本改变。偷拍视频有庞大市场需求,才催生出黑色产业链。光打击制作者不够,得整治买方市场。韩国警方去年抓了不少偷拍团伙,但那些付费观看的网民很少被追究。没有需求就没有伤害,这话在数字性犯罪上尤其适用。 新机构还有个任务:预防教育。进学校、进社区,教大家识别偷拍设备,了解AI换脸风险。这个方向对了,但得用年轻人听得懂的方式。板着脸讲法律条文没人听,得用短视频、漫画这些形式。韩国K-pop、韩剧影响力大,能不能请明星代言反数字性犯罪宣传?民间团体早就呼吁了,就看政府愿不愿意做。 个人观点是,韩国成立这个组是好事,但别指望一劳永逸。数字性犯罪是技术问题,更是社会问题。法律要严惩,技术要拦截,平台要负责,教育要跟上,四管齐下才可能见效。最怕各部门还是各干各的,支援组又变成一个协调会,那真没救了。 未来挑战还很多。AI技术还在进化,明年可能出更逼真的换脸工具。犯罪手法也在翻新,从公共厕所偷拍到无人机偷拍,防不胜防。韩国这次算是开了个头,路还长着呢。其他国家也盯着看,韩国要是能摸索出有效模式,说不定能成为全球样本。 各位读者你们怎么看?欢迎在评论区讨论。