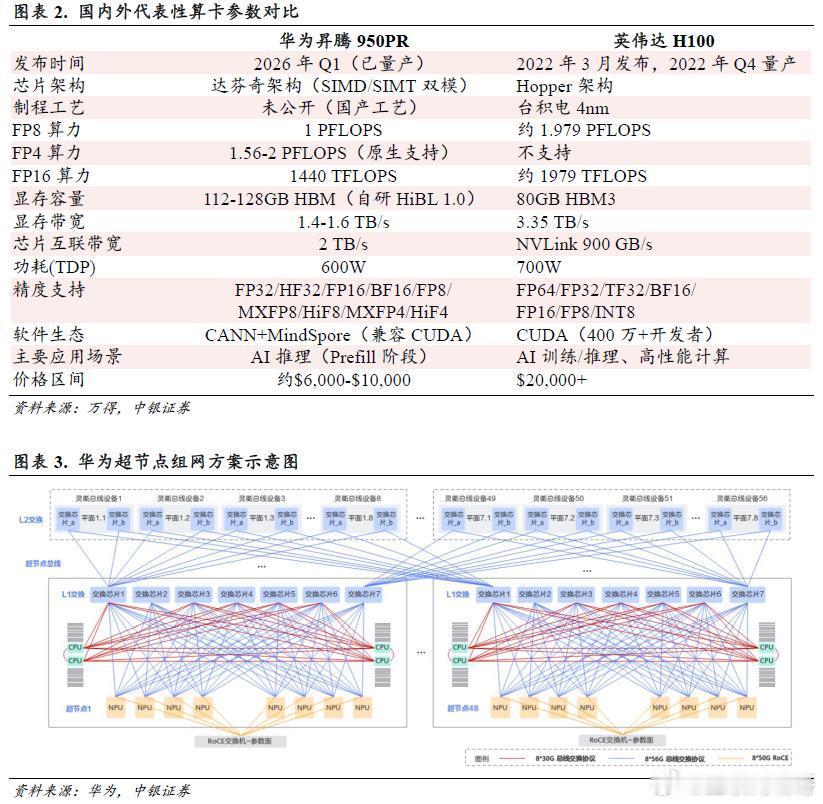

今天我把盯盘系统切换到DeepSeek V4新版本后,成本下降幅度让我大吃一惊! 4月24日上午,DeepSeek V4预览版上线。 我没有第一时间去研究参数,而是赶紧做了一件事 ——把盯盘系统的模型切到DeepSeek V4 Flash。 原因很简单: 先测算使用成本,然后再看效果。 【我的成本账】 以前用Claude,每百万token输出要15-75美元。 现在用V4-Flash,输出只要2元人民币。 什么概念? 同样的预算,原来跑1次,现在能跑250次。 我的自动盯盘系统每天调用几百次, 切过去之后,月度AI成本直接从四位数降到两位数。 【但这次不只是便宜】 Deepseek V4系列有两个版本: • V4-Pro:1.6万亿参数,对标Claude Opus 4.7,性能差距只有两个月。 • V4-Flash:2840亿参数,速度快、成本低,我的盯盘系统现在用的就是这个。 两个版本有个共同点:100万token上下文,标配。 以前这是高端闭源模型的选配,现在变成基础款。 相当于宝马7系的配置下放到了3系。 【Agent出现了11次】 DeepSeek的产品介绍里,"Agent"这个词出现了11次。 不是在秀技术,是在划地盘—— 大模型价格战,从"聊天便宜"打到了"Agent便宜"。 聊天便宜只是玩具,Agent便宜才是生意。 当单次调用成本降到几分钱,企业级AI应用才真正算得过账。 【影响的不只是成本,是产业链】 第一层:国产算力 DeepSeek V4全程用华为昇腾950PR和寒武纪MLU训练,不是英伟达。 昇腾950单卡算力是H20的2.87倍,价格是H200的1/3。 DeepSeek把适配代码全开源了,等于告诉所有人: ——不用英伟达的CUDA,也能跑顶级模型。 第二层:AI应用爆发 推理成本降了20-100倍, Agent应用门槛归零。 • 企业知识库问答 → 现在几乎零成本 • 代码生成辅助 → 团队人均配一个AI程序员 • 金融数据分析 → 类似我这种盯盘系统会大量涌现,因为成本还会继续降低 第三层:存储和光模块 100万token上下文意味着KV缓存暴增,对存储芯片需求直线上升。 同时算力总盘子还在涨,光模块、交换机、高速铜连接的需求不会降。 【潜在机会总结】 1、国产算力 :昇腾生态从"可用"到"好用" ,华为产业链、寒武纪等。 2、AI应用:成本归零,Agent爆发,企业服务、金融IT 。 3、存储芯片:长文本需要更大KV缓存,存储龙头 。 4、光模块 :算力需求持续增长 ,中际旭创等。 【一个反直觉的判断】 很多人担心"模型便宜了,算力公司是不是就没戏唱了?" 恰恰相反。 DeepSeek把模型成本打下来,反而会催生出海量AI应用。 应用多了,算力总需求只会更大。 不是算力需求崩塌,而是算力需求结构变了 ——从训练转向推理,从国外芯片转向国产芯片。 这就是我当下判定的一个“确定性”,你做好跟进的准备了吗? 评论区说说你的意见。 【数据来源】 • DeepSeek V4技术报告(58页) • 官方API定价文档 • OpenRouter平台实时调用数据 • 36氪、智东西、极客公园报道 免责声明:以上分析基于公开信息,不构成投资建议。