每次中国模型公司发货,都是开源界的盛事。

昨天 DeepSeek V4 发布,开源闭源之争再次被摆上台面。

开源携手并进、闭源明争暗斗,这个评价你就说准不准吧 ?

DeepSeek 开源的 MLA 架构已经变成业界标准,中国的很多大模型都采用了该架构,例如 Kimi K2。

而本次 DeepSeek V4 采用了 Muon 优化器。

该优化器最早由独立研究者 Keller Jordan 在2024年底的博客里提出,月之暗面团队对其做了关键改进,叫 MuonClip,在万亿参数规模上验证了稳定性。预训练全程零 Loss Spike。

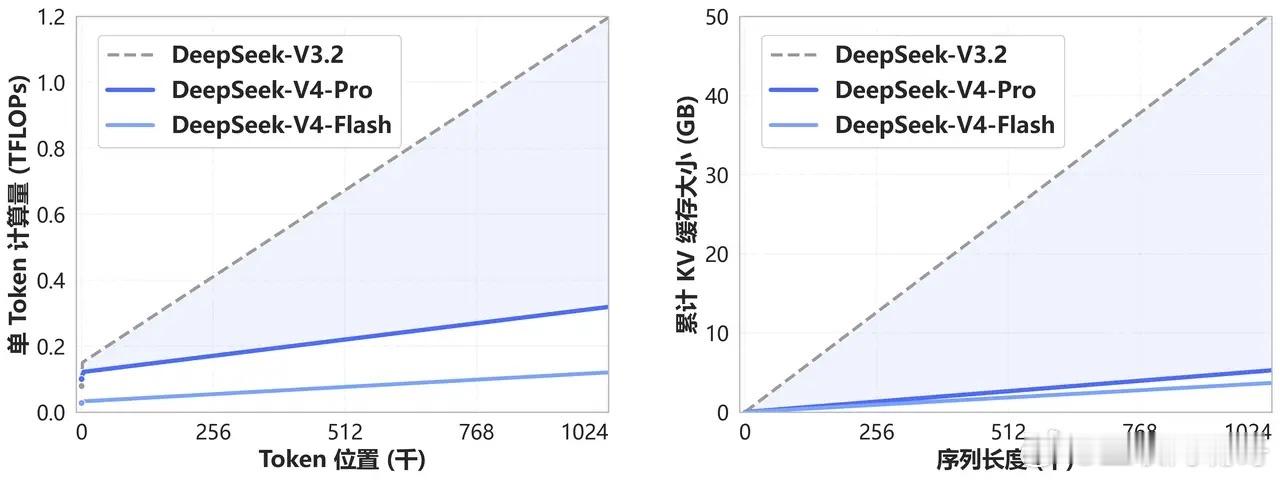

DeepSeek V4 Pro 的参数 1.6T,V4 在大多数模块都采用了该优化器。

没有授权谈判。没有专利纠纷。技术通过论文和开源代码流动,谁做得好就用谁的。

这就是中国开源公司之间的默契。

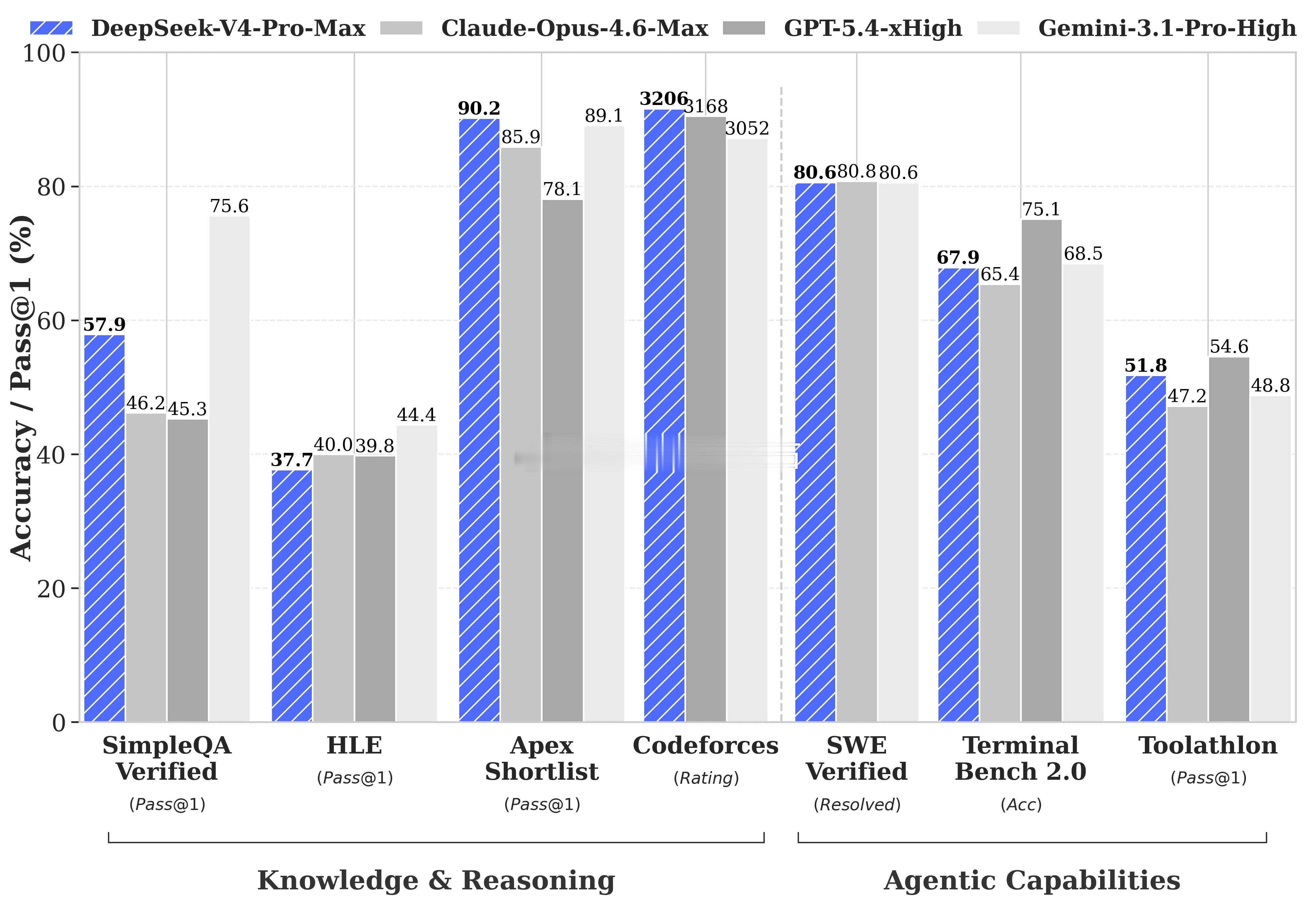

反观美国的闭源公司,Anthropic 和 OpenAI 早已不在暗斗阶段,两者的竞争早已被摆在台面上。

OpenAI 前段时间被 Anthropic 300 亿美元 ARR 的数字压得喘不过气来,首席营收官 Denise Dresser 在内部备忘录里直接开喷 Anthropic 的各项策略,更是宣称 Anthropic 夸大了 80 美元的营收。

美国闭源公司在玩一种叫 AI 震慑力的游戏,只有拥有绝对统治力的公司才觉得有安全感,他们拥有最多的资源,但却不敢在前沿和战略上犯一点错误,任何一点弯路,都会给对手可乘之机。

在 Anthropic 领先的这些日子里,OpenAI 压力山大,全面调整了模型和产品策略。在经过这一周的发布之后,Anthropic 的口碑一般,反倒是 OpenAI 的反响不错,扳下了一城,Sam Altman 觉得这一周过得不错。

与此同时,中国开源公司在玩一种极致创新、科技普惠的游戏,他们没有那么多的算力资源,只能通过算法和架构的创新来压榨有限的算力。

限制激发了创造力,中国公司不仅自发创新,也愿意集众家之长,并分享自己的技术成果。

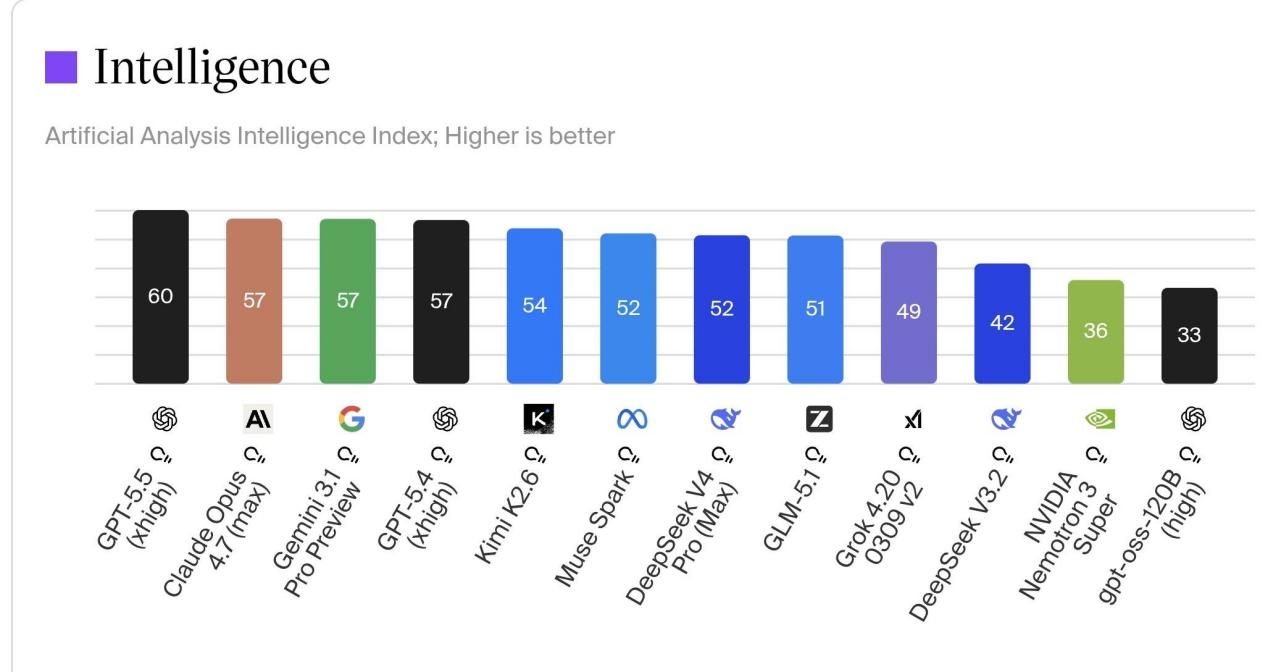

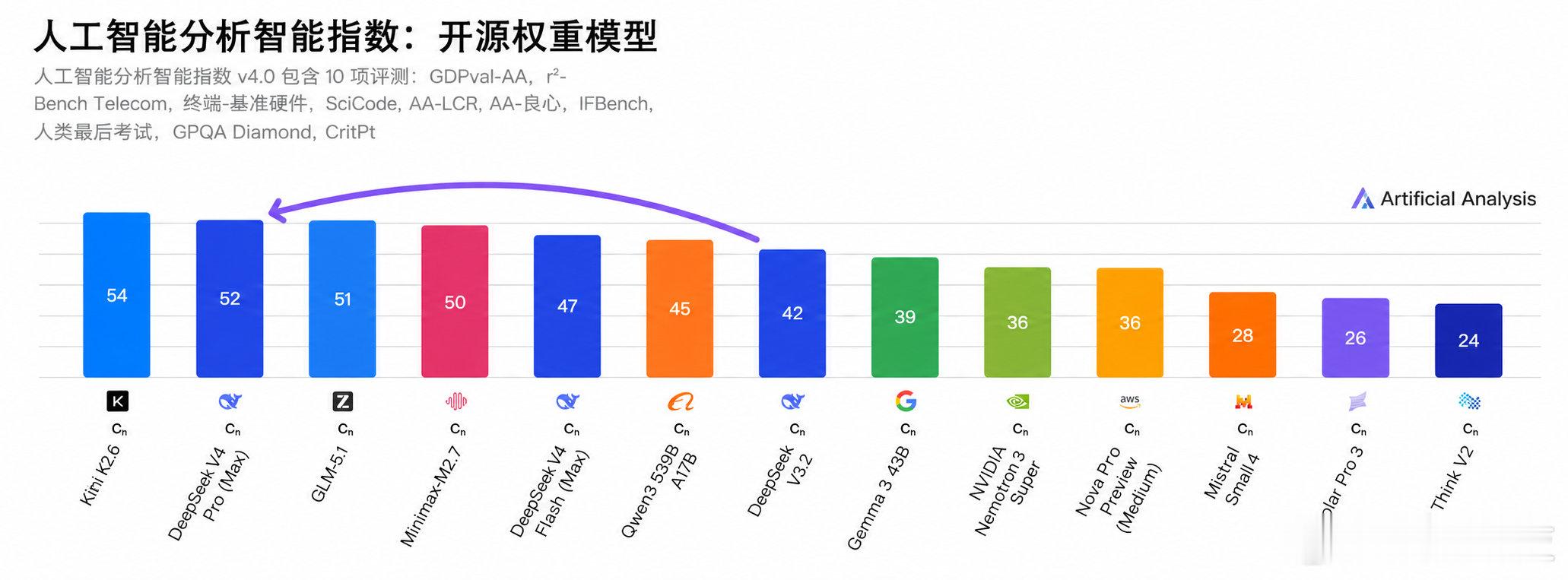

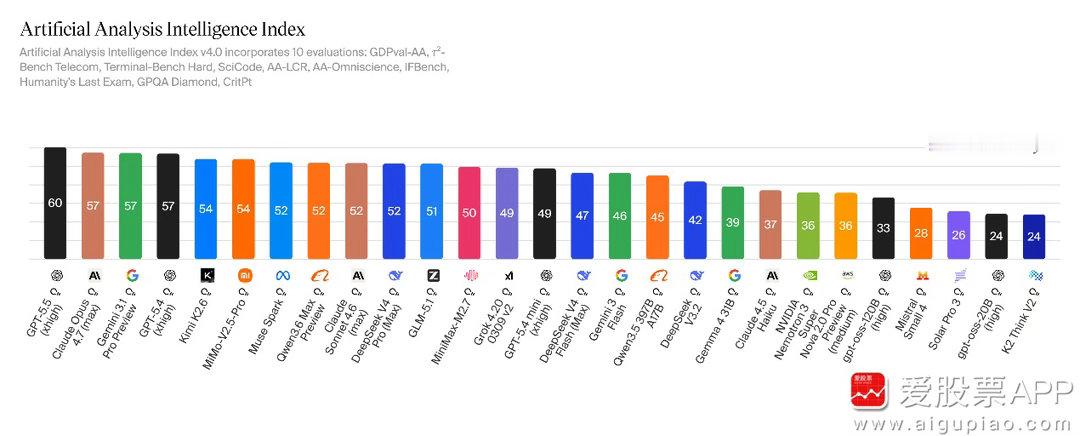

能力方面,Kimi K2.6(54分)与 DeepSeek V4 Pro(52分)已经构筑了极其坚实的防线,不仅稳稳压制了 Grok 4.20 等海外模型,更是直接逼近了耗费巨资训练的闭源双雄——GPT-5.5(60分)与 Claude Opus 4.7(57分)。

Replit 首席执行官 Amjad Masad 说的好,中国科学家能惠及所有人,包括美国的小型(甚至可能是大型)实验室。

但他们却在持续被低估,这群用了 1/10 资源训练模型,且愿意分享的公司,估值只有美国大型实验室的1/20、1/30。

甚至有人在说 DeepSeek 最新估值 440亿美元贵了,这让人费解。

或许只有很少的人愿意相信开源会赢,大家还是更相信垄断的叙事。

在过去很长时间里,大家习惯用融资额、算力规模、模型排行榜,去判断一家 AI 公司的未来。

但 AI 这件事,未必只有资本、智力密度竞赛一条线。

它也是一场技术扩散速度的比赛,一场谁能把前沿能力变成全行业基础设施的比赛。

闭源公司当然会继续强大,它们会定义最高处的天花板。但开源公司正在做另一件事:把天花板拆下来,变成更多人脚下的地板。

或许,中国的开源模型公司需要被重新估值了。