这两天刷开发者社区,发现一个挺有意思的现象。

很多人开始折腾OpenClaw、搭Agent workflow、接各种Skill。

看起来挺热闹,但真正做起来,很快就会卡在一个地方:

Agent其实很多时候是“看不见东西”的。

原因很简单。

真实世界的大量信息并不是结构化数据,而是藏在各种文档里:

发票,PDF,合同,扫描件,截图,表格

这些东西,人看一眼就明白,但如果Agent没有文档解析能力,它其实根本处理不了。

所以很多开发者最近都在补一块能力:

让Agent看懂文档。

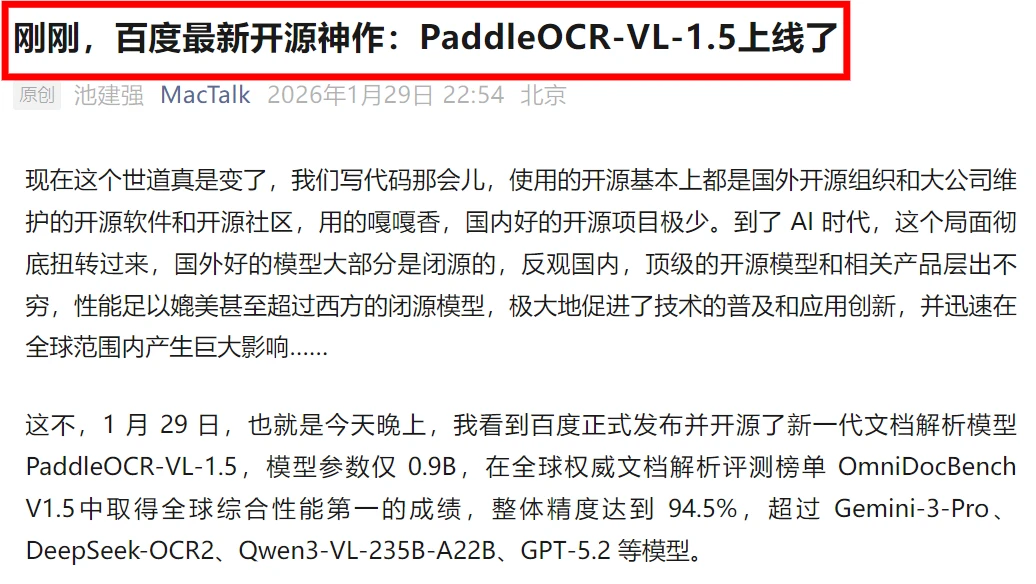

最近看到一个动作还挺典型。

基于文心大模型体系训练的文心衍生模型PaddleOCR文档解析能力,已经作为Skill上架到了OpenClaw的ClawHub。

简单理解就是:

Agent workflow里现在可以直接调用这套文档解析能力。

比如:

拍张发票

→ 自动识别金额、时间、抬头

→ 输出结构化信息

或者:

丢一份PDF

→ 自动提取关键信息

→ 进入后续自动化流程。

这种能力以前很多人都是自己接OCR接口、再自己做解析,现在直接一个Skill就能用。

其实这背后反映的是一个更大的变化:

文心能力正在以组件形式进入Agent工具生态。

大模型负责理解和推理,

工具负责执行能力。

而像PaddleOCR这种文档解析,本质上就是在给Agent补“视觉能力”。

这套东西在开发者社区里本来就挺有存在感:

GitHub 70k+ star

支持110+语言识别

能解析表格、公式、复杂文档结构。

新一代模型甚至可以处理:

歪着拍的文档

弯折扫描件

复杂版面。

很多现实业务里那些乱七八糟的材料,它基本都能读出来。

当这些能力被做成Skill接进Agent生态,其实意味着一件事:

Agent开始真正能处理现实世界的数据,而不只是聊天。