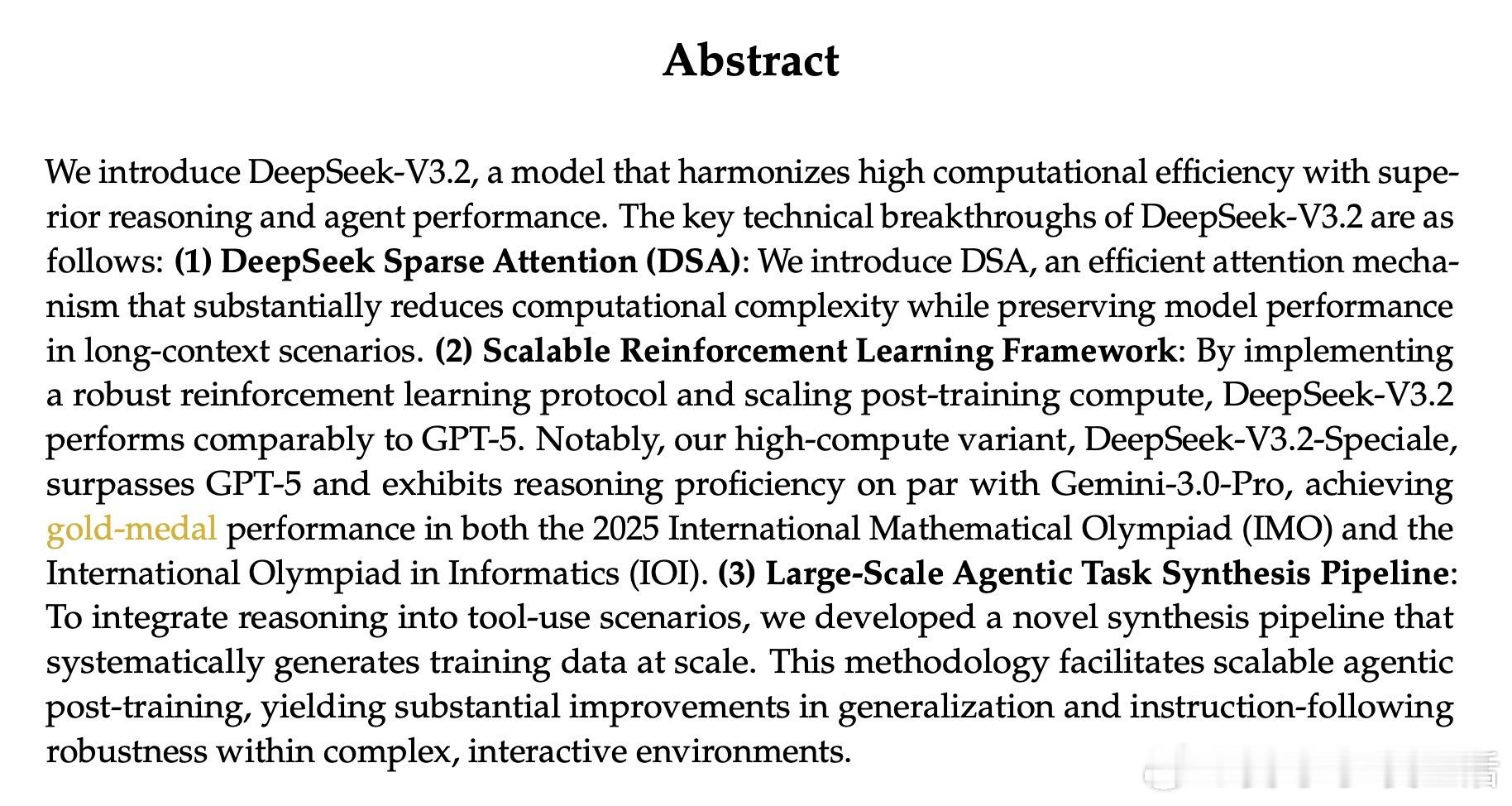

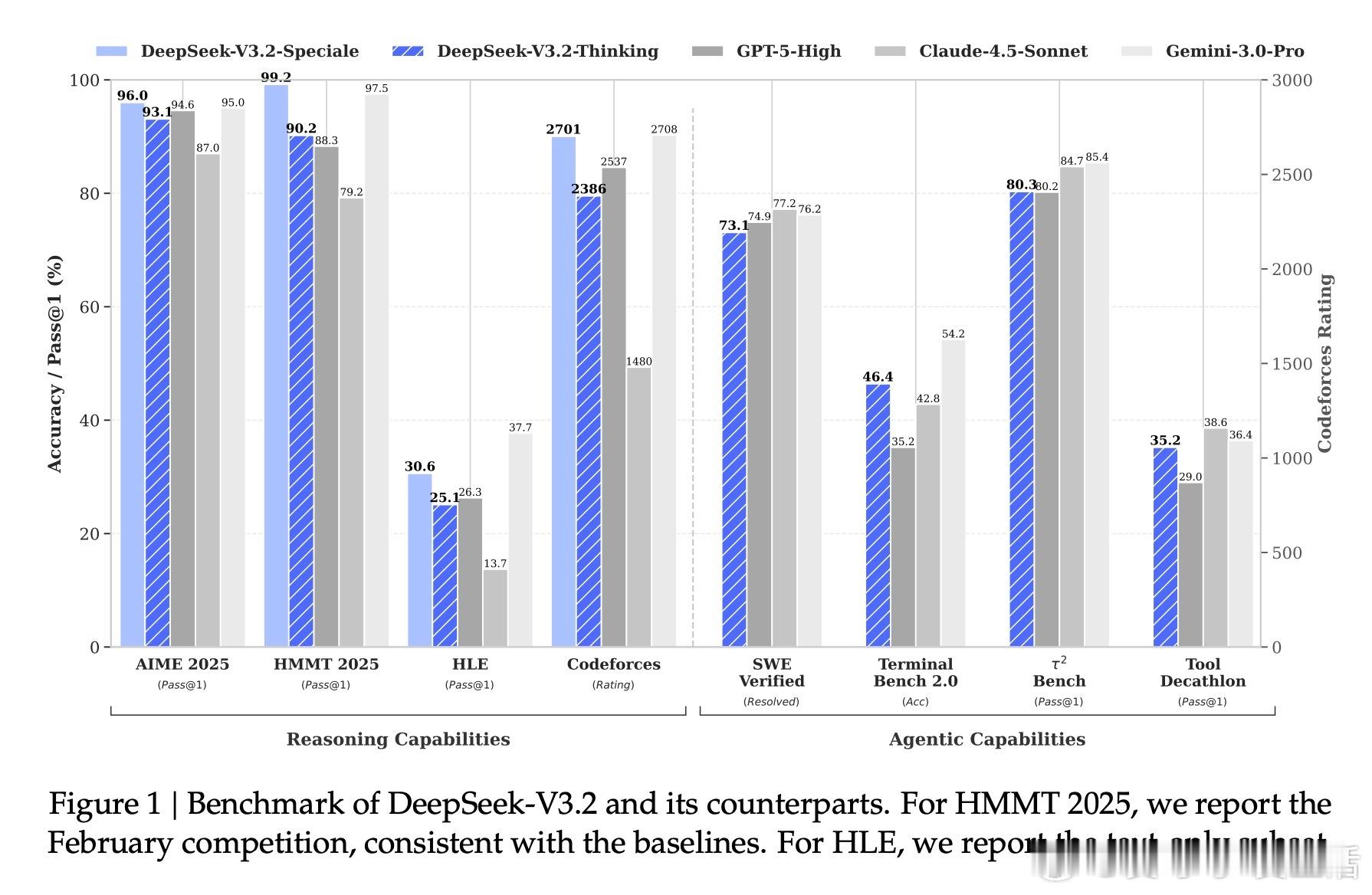

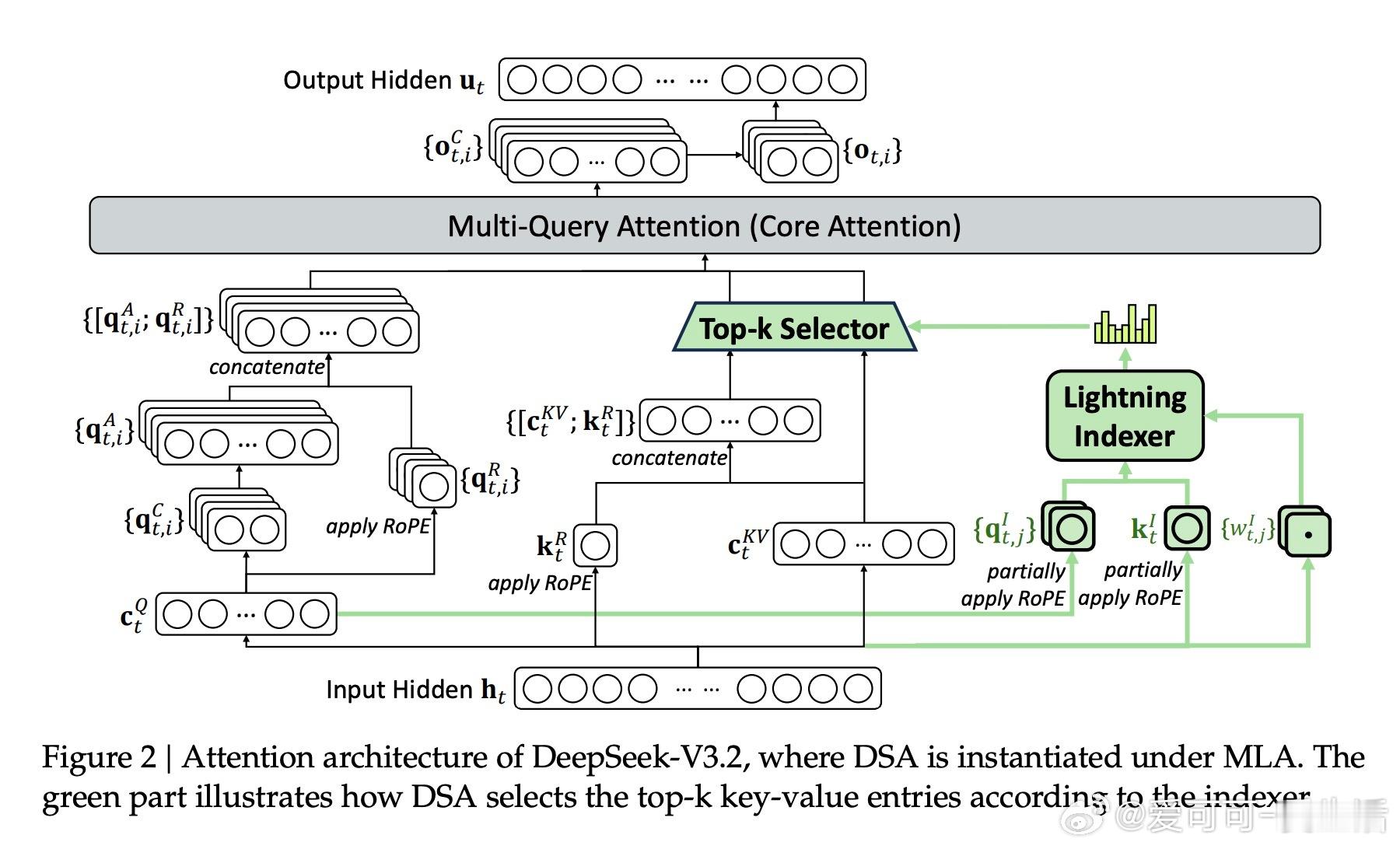

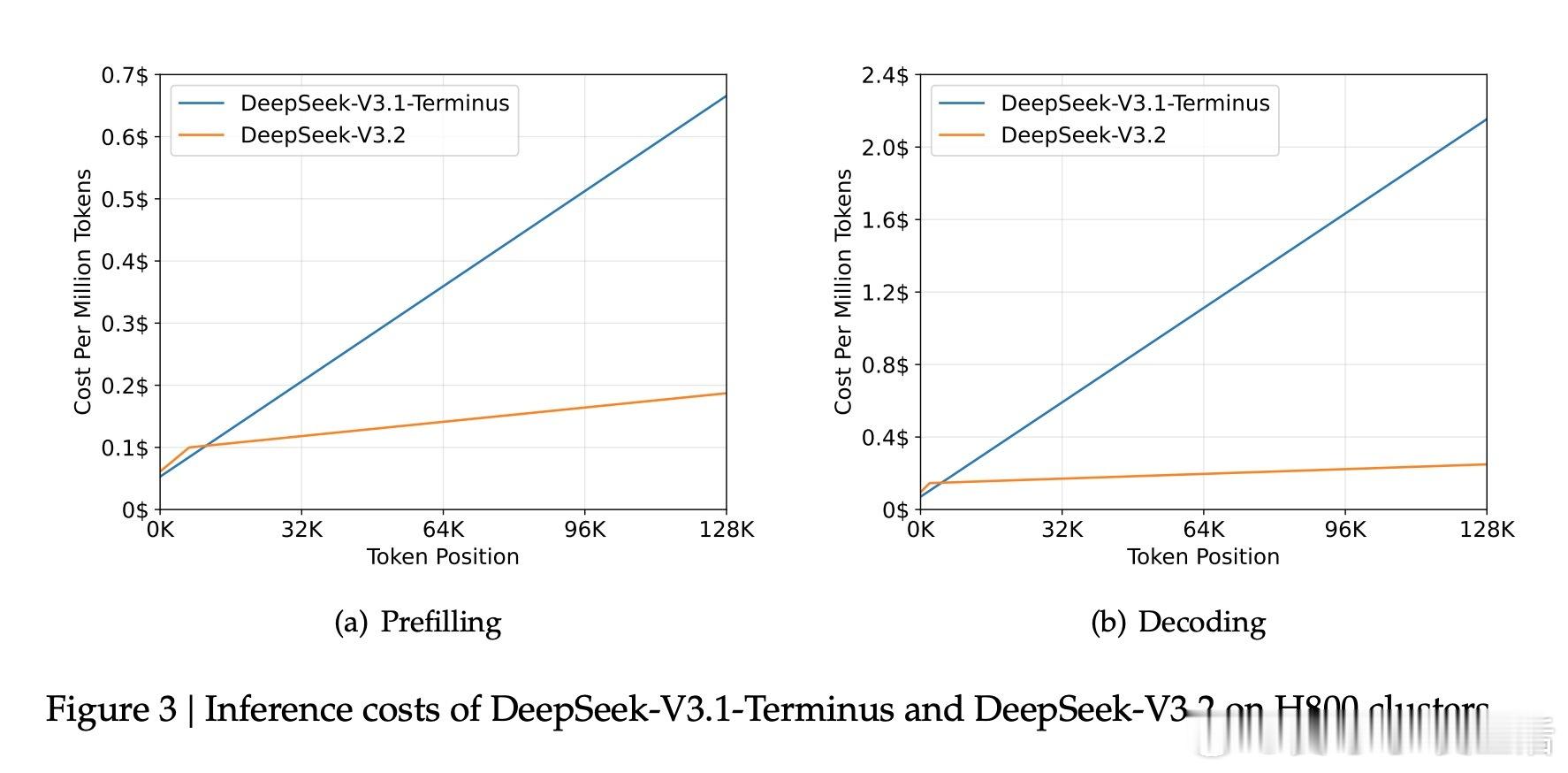

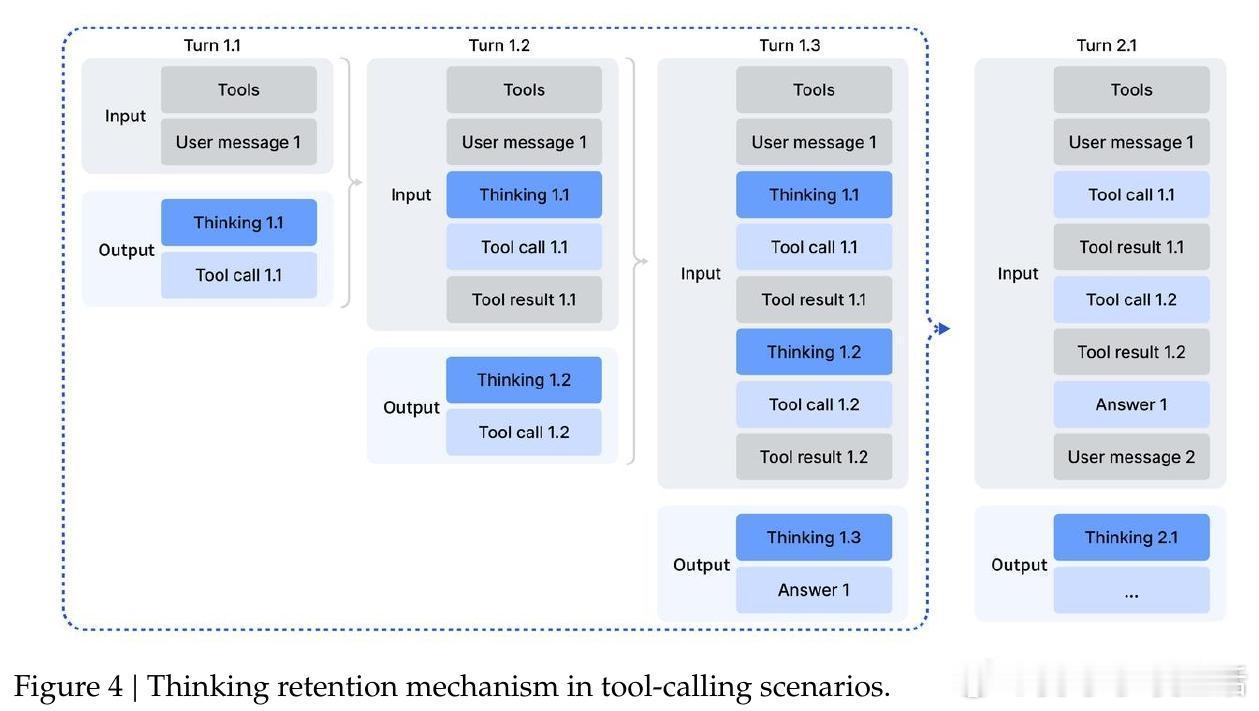

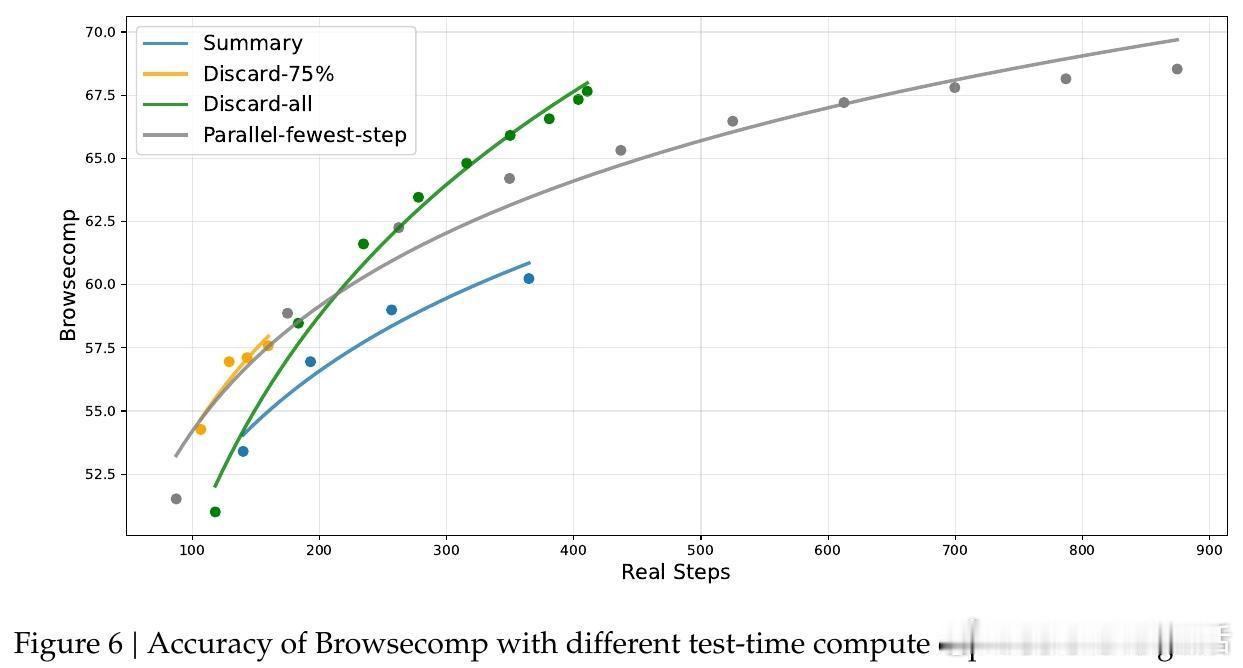

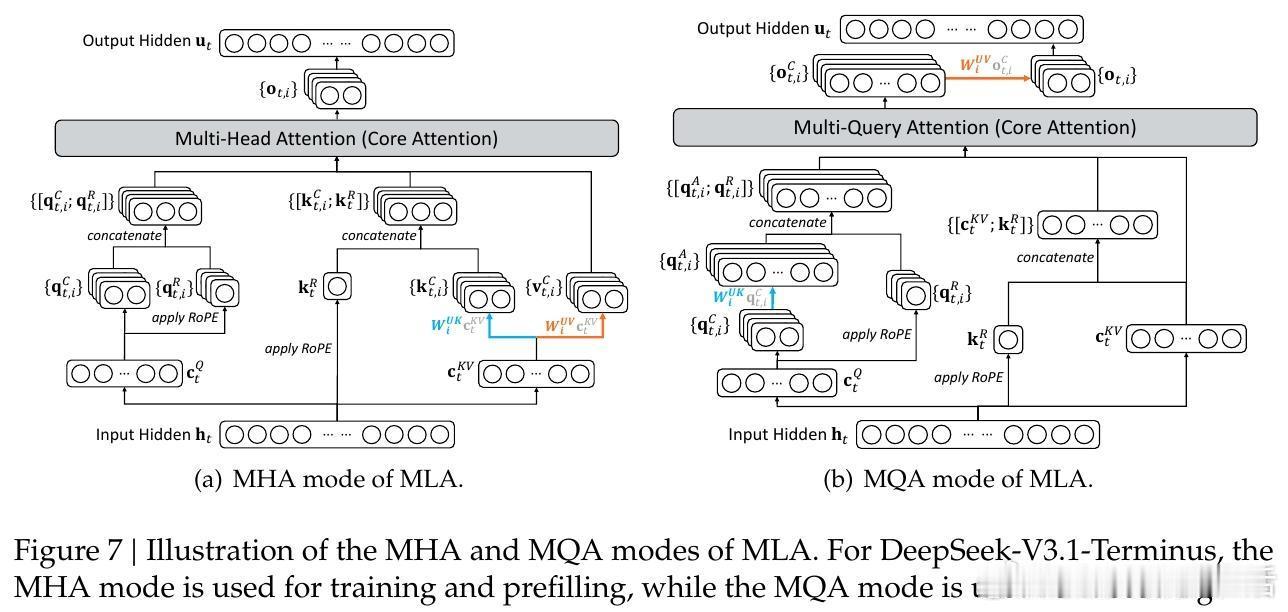

[LG]《DeepSeek-V3.2: Pushing the Frontier of Open Large Language Models》[DeepSeek-AI] (2025) DeepSeek-V3.2发布,开创开放大语言模型新纪元!DeepSeek-V3.2融合了高效计算与卓越推理及Agent性能,三大核心突破引领行业前沿:1. DeepSeek稀疏注意力机制(DSA),极大降低长上下文计算复杂度,同时保持性能稳定。2. 可扩展强化学习框架,后期训练算力投入超预训练10%,使DeepSeek-V3.2表现接近GPT-5,高算力版本Speciale更超越GPT-5,与Gemini-3.0-Pro并驾齐驱,荣获2025年IMO与IOI金牌。3. 大规模Agent任务合成流水线,生成1800+环境和8.5万复杂指令,显著提升工具调用下的泛化与指令跟随能力。多项评测中,DeepSeek-V3.2在推理任务表现媲美GPT-5-High,代码Agent任务优于开源对手,搜索Agent和工具使用能力大幅提升,成功缩小与闭源顶尖模型的差距。特别是Speciale版本,在IMO、IOI、ICPC世界总决赛等顶级赛事中实现金牌成绩,标志着开放模型推理能力的新高度。成本与效率方面,DSA带来显著推理加速,推理成本大幅下降,但仍面临知识广度和令牌效率的挑战,未来将持续优化。核心亮点还包括创新的上下文管理策略,解决长上下文任务截断难题,提升实际应用稳定性与性能。深度集成推理与工具调用的冷启动和大规模强化学习策略,推动模型在复杂交互环境下的表现。欲了解详细技术细节、实验数据及开源资源,请访问:网页链接未来,DeepSeek团队将继续扩大预训练算力,提升知识覆盖和推理链条效率,追求更强大、更经济的开放大模型。——DeepSeek-V3.2技术报告:modelscope.cn/models/deepseek-ai/DeepSeek-V3.2/resolve/master/assets/paper.pdf